我们经常在网上浏览有关人工智能的新闻,都明白人工智能的核心在算力,算力越高,人工智能的硬实力越强。那么,谁能告诉我,算力到底是什么?怎么计算?算力和内存、带宽有什么关系?

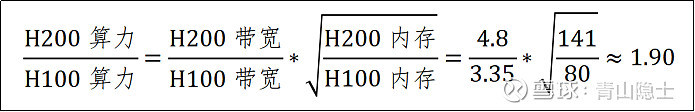

或者举个例子吧!英伟达先后出了H100和H200两款GPU,逻辑芯片相同,区别主要是以下两点:一是H100显卡的内存为80GB,H200显卡的内存为141GB;二是H100显卡的带宽为3.35TB/s,H200显卡的带宽为4.8TB/s。

请问,H200的算力比H100增加了多少?

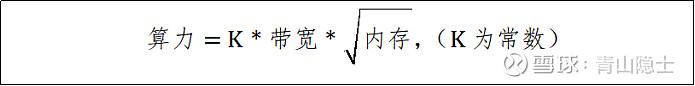

一、算力的简单计算公式

鉴于当前逻辑芯片的提升空间有限,提升算力的重要任务基本上都落在了HBM身上,HBM的两大核心指标分别是内存和带宽。

因此,在考虑逻辑芯片,只考虑HBM性能提升的情况下,GPU算力的计算公式可以简单概括为:

根据上面这个简单公式,我们就可以算出来H200比H100的算力提升了多少。

即,H200相比H100的算力提升了90%。

二、举一道小数数学题的例子来解释算力是什么?

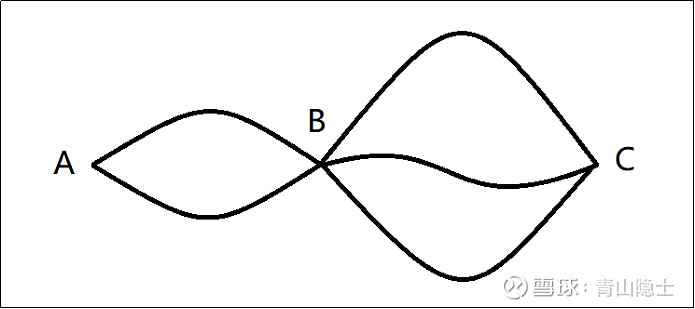

从A地到B地有2条路可走,从B地到C地有3条路可走,那么从A地经B地到C地共有多少条路可走?

这道题的解答过程很简单,就是2乘以3等于6。

举这个例子的意思,其实是想说,GPU的算力就类似于A到C的路径选择有多少条,A到B的路越多(带宽越大)或者B到C的路越多(内存越大),A到C的路径选择就越多(也就是算力越高)。

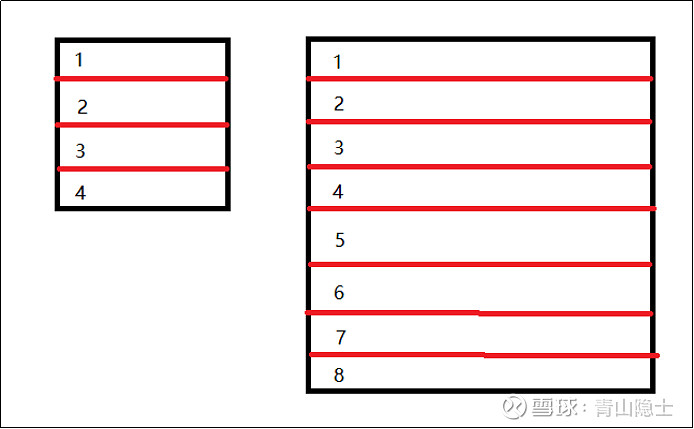

那么为什么内存在算力的计算公式里要加上根号呢?我们再用两个正方形的例子来解释一下。

左边的正方形的边长是4,面积是16(这个面积就是左边芯片的内存);右边的正方形的边长是8,面积是64(这个面积就是右边芯片的内存)。假设面积代表内存,那么右边正方形的内存就是左边的4倍。但是如果考虑路径通道的条数(这个影响算力),左边正方形(从左到右)的路径是4条,右边正方形(从左到右)的路径是8条,这意味着,右边正方形对算力的贡献值其实是左边的2倍,而右边正方形的内存却是左边的4倍。

三、正确理解HBM

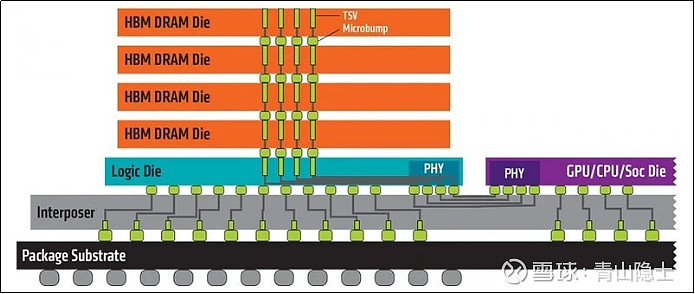

上图就是HBM的简单原理图,想要提高带宽,就需要图上的TSV多打孔(路的条数增加)或者孔径增加(路的宽度增加)。这显然是有极限,不可能无限制地增加打孔数量和无限制地扩大孔径。

另一种办法,就是把上图的DRAM多垒几层,显然这个要求就低得多了,因为只要你学会了垂直堆砌内存芯片(DRAM)的工艺,堆2个,堆3个,甚至堆4个,都不是问题,直到发热、结构稳定性出现问题为止。

四、相关个股分析

(一)中微公司。中微公司是TSV设备主要供应商,能够提供8英寸和12英寸硅通孔刻蚀设备,可刻蚀孔径从低至1微米以下到几百微米的孔洞。

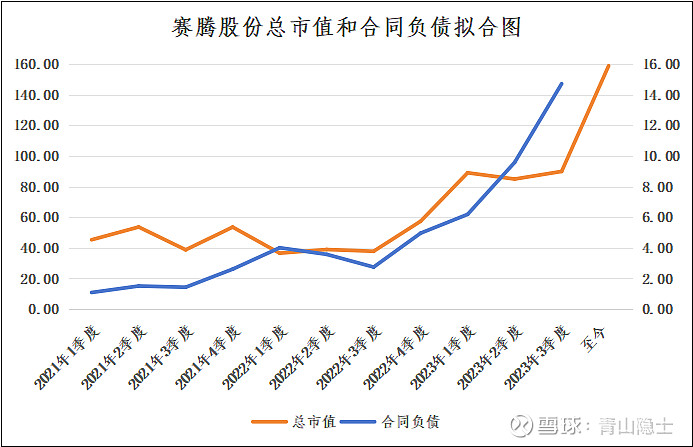

(二)赛腾股份。2023年11月,苏州赛腾股份紧随CAMT之后,拿到三星的量测设备美元大订单(明年上半年交付,后续随着三星HBM扩产大概率持续加单)。从赛腾股份3季度报看,赛腾股份2季度末的合同负债为9.58亿元,3季度末的合同负债为14.71亿元,环比增加5.23亿元。(估值方法:1元合同负债对应10元市值)

(三)太极实业。太极实业持股55%的海太半导体与SK海力士合资,专为SK海力士提供DRAM封装测试业务。

(四)香农芯创。香农芯创是代理SK海力士HBM产品的分销商,因为国内暂时不具备生产HBM的能力,因此,香农芯创具备“人无我有”的市场地位。

(五)深科技。深科技旗下沛顿科技配套CX存储,占CX存储5成以上封测份额。同时,沛顿科技正在布局HBM等更先进的存储产品封装工艺。

(六)长电科技、通富微电、华天科技等封测厂商。这些封测企业具备2.5D/3D的技术能力,有相关生产的可能性。

这里先不提壹石通、雅克科技、华海诚科等HBM材料供应商,等我能够量化HBM对这类企业业绩的直接影响有多大再细致地写写。

$中微公司(SH688012)$ $长电科技(SH600584)$ $华天科技(SZ002185)$

@雪球创作者中心 @今日话题 @不明真相的群众 @孥孥的大树 @肖志刚 @周期合伙人

免责声明:本文不构成投资建议,文中观点,仅代表个人操作,不具有任何指导作用。