作者 | 褚杏娟

明确不参与“价格战”的王小川,在 5 月 22 日做了两个重要发布:最新一代基座大模型 Baichuan 4 和成立后的首款 AI 助手“百小应”,同时强调了百川智能的 AGI 发展路径:超级模型 + 超级应用。

“模型还没有到超级模型,应用上还没有到超级应用。”王小川在发布会开始就很明确地说道,“我们在通往 AGI 的路上。”但这次发布仍然对百川来说意义非凡,Baichuan 4 的模型能力达到了国内第一,也正式入局了 C 端市场。

模型能力,国内第一

相较 1 月底发布的 Baichuan 3,Baichuan 4 在各项能力上均有极大提升,其中通用能力提升超过 10%,数学和代码能力分别提升 14% 和 9%。

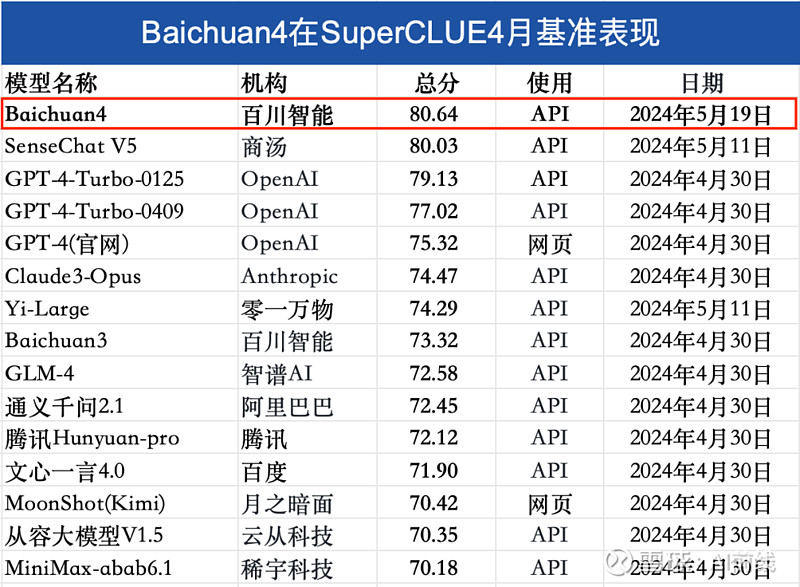

榜单成绩已经是各家发布大模型时的必备项目了。这次,百川分享了国内权威大模型评测机构 SuperCLUE 的评测结果。在最新的测试结果中,Baichuan 4 的模型能力达到了国内第一。

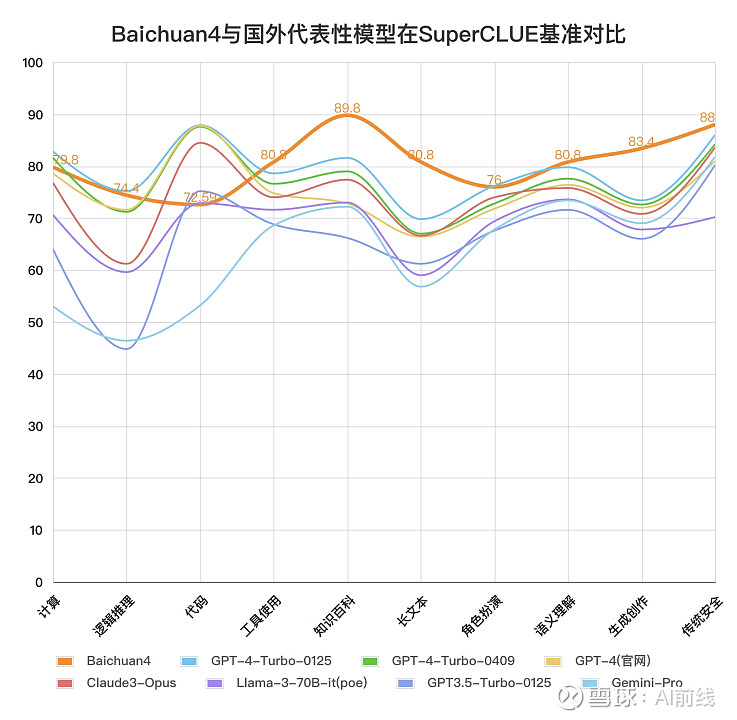

与国外主流大模型对比,Baichuan4 在知识百科、长文本、生成创作等文科类中文任务上明显优于国外大模型。

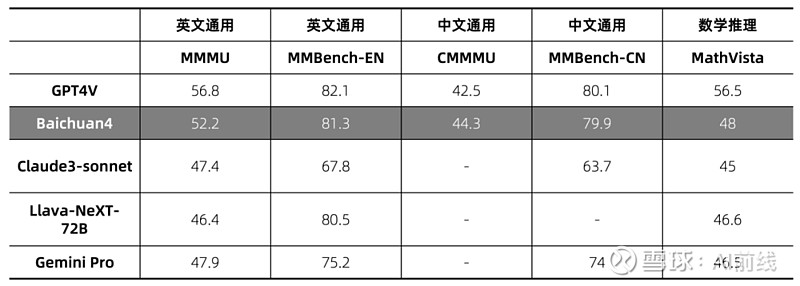

此外,Baichuan 4 还具备行业领先的多模态能力,在 MMMU、MMBench-EN、CMMMU、MMBench-CN、MathVista 等评测基准上表现优异,大幅领先 Gemini Pro、Claude3-sonnet 等多模态模型。

不过王小川也表示,相较多模态,百川更关注于文本能力。“多模态没有智力”,王小川解释道,多模态只是建立了一个分类的体系。而在像“1+2=3”这个等式里,智力不体现在 1+2 如何等于 3 的计算里,而是在等号里面。

Baichuan 4 能在较短的时间内取得突破,源于其在训练过程中引入了诸多领先技术优化手段:

数据方面,在预训练阶段采用了基于 Model-based+Human-based 的协同数据筛选优化方法,以及对长文本建模位置编码科学的 Scaling Law,有效提升了模型对数据的利用;

SFT 对齐方面,重点优化了模型 Reasoning、Planning、Instruct following 能力,通过 loss 驱动的数据选取与训练,多阶段爬坡,多模型参数融合等方式有效提升了模型的关键指标和稳定性;

突破 RLHF 和 RLAIF 融合的 RLxF 强化学习对齐技术,大幅提升模型的指令遵循等能力;

成本方面,提出了新的投机采样方案 clover,通过将序列知识与并行解码结合,使得投机采样的命中率提升至 60%,成本降低 30%以上。

此外,百川智能还宣布开放 Baichuan 4、Baichuan3-Turbo、Baichuan3-Turbo-128k、Assistant API 四款 API :

“价格战是云厂商的游戏”

王小川坦言,当前 API 收入对百川而言并不多,也构不成收入重点。

对于最近大模型市场打得火热的“价格战”,王小川表示,一方面,这表明了大家太看好大模型前景,不愿意失去任何机会,宁愿零价格也要进来入场;另一方面,降价的核心是要看商业模式的,如果是做 ToB 服务,最后售卖的不是模型本身而是整套云服务。云厂商是比较偏传统的服务模式,进到一个新的战场可以降价,但降价仅限于云厂商。在有限场景打价格战,已经走出了创业公司的射程。

“这波降价跟之前的滴滴美团还不一样,因为那会儿的价格战或补贴背后带有网络效应,是双边网络,那个商业模式在改变生产关系,比如司机和乘客的关系、外卖员和用户之间的关系。而这次降价更像当初四小龙的降价方式,而不是像滴滴美团这样的价格竞争,这次不是生产关系的改变,而是直接做生产力供给。我觉得这件事情对我们而言,就是别掺和进去。”王小川说道。

除了大模型发布,百川智能还推出了全新的 MaaS+AaaS 服务。MaaS 版块由基座模型组成,分为旗舰版和专业版。旗舰版将全量开放 Baichuan 4 的各项能力,专业版包含 Baichuan3-Turbo 和 Baichuan3-Turbo-128K 两款模型,价格比旗舰版 Baichuan 4 更实惠,且对企业高频场景做了针对性优化,综合测试相比 GPT-3.5 整体效果提升 8.9%。百川智能表示,MaaS 的新用户即日起可以获得 1000 万免费 token。

Assitants API 则是百川智能在 Baichuan 4 基础上针对 Agent 构建推出的 API 接口,不仅支持 Code interpreter、RAG 内建工具,还支持自定义工具调用,方便企业接入各种丰富复杂的 API。据悉,百川智能未来还将推出零代码 Agent 创建平台产品。

超级应用

“之前我就提到一定要有自己的超级应用,如果只是学 OpenAI 一开始有个模型做 API 服务,在中国的创业公司而言,是走不通的。”王小川说道。

对于这一点,王小川的考虑有三:首先,虽然在美国做 ToB 是好生意,但在中国的商业环境中,C 端市场就比 B 端大 10 倍;其次,做 To B,收的是人民币,花的是美金;最后,大厂都会卷这件事情,这是大厂射程范围内的。因此,百川智能一定要做差异化,低价作为市场竞争力是不够的。

这次,百川智能终于发布了自己的首款 C 端应用:“百小应”。当被质疑这款应用是不是发晚了的时候,王小川直言,“我正好觉得相反,发早了。”他认为,之前的各种应用更多是为了展示大模型能力,而到现在这个领域还没有到一个成熟的状态。

王小川理想中的 AI 助手是有温度的,“作为伙伴,而不是工具”。他不吝惜对 Kimi 的赞赏,“Kimi 打赏的理念,就是不是把它当工具,而是当成一个伙伴、一个人。”

“懂搜索、会提问”是百川给百小应总结的有别于其他 AI 助手的地方:

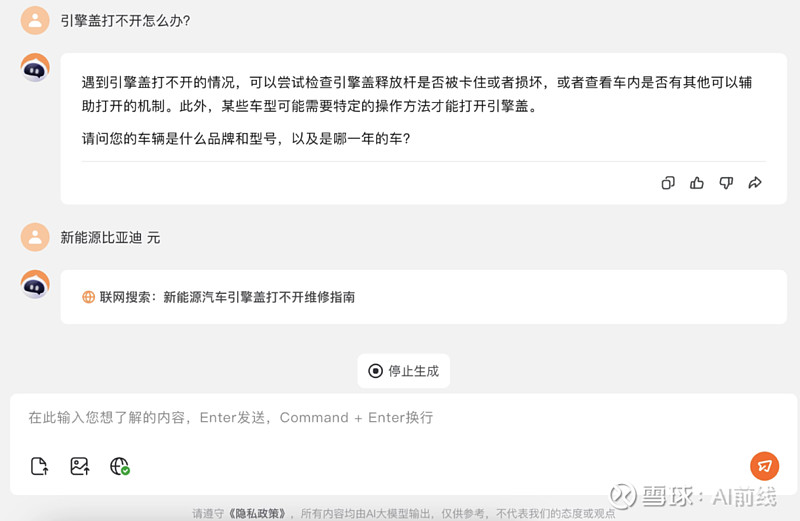

“懂搜索”意味着不是像其他搜索一样做汇总,而是让模型掌握专业的搜索技能,用户在搜索的时候理解意图、可以拆词作多轮搜索。

“会提问”则是让模型能引导用户表达自己的需求。这是由于当前很多人在搜索时表达只有关键词、不够准确,机器只能去猜,现在百川则是通过让机器反问的方式让用户表达出来,比如:

除了强大的搜索和提问功能以外,用户还能在百小应中上传 PDF、word 文档,或者直接输入网页链接(URL),阅读并分析书籍、报告、学术论文等长篇内容,百小应一分钟就能读完上市公司财报。

在 Baichuan 4 多模态能力的支持下,用户提问的同时还可以同步上传图片,百小应对图片内容进行解读,或者将图片作为补充材料,获取更精准的回答。此外,它还支持用户通过语音的方式进行交互。

王小川表示,百小应发布后不会为了获客疯狂投广告,“这并不是健康的行为。”“我们手上有足够的资金,不会通过立马发布一个产品去寻找下一轮融资。我们的精力会放在产品价值上。”

对于商业模式,王小川认为现在还不到时候。“以 Kimi 为例,虽然现在有足够的用户体量,不管是走流量模式还是广告模式都有意义,但其实没有本质的区别。”具体的变现时机,要看一个场景下多少用户有付费意愿。

当然,现在的百小应并不是王小川心目中的超级应用,“今天百万级 DAU 都远远称不上一个超级应用至少要再提升两个数量级。”王小川预计,百小应今年内会有大的升级变化。

“同一代模型中,百川更有机会把超级应用做出来。”王小川说道。显然,百川智能对超级模型和超级应用两个赛道都非常有信心,“百川未来可能不再按月发布,而是按季度发布,团队要把时间调到长线来做事情。”王小川说道。

未来百川智能将如何实现自己的 AGI,我们拭目以待。

报告推荐

大模型技术正在引领行业发展创新浪潮。那么,如何让大模型技术与行业深度融合?如何通过大模型技术为各行各业提供更加智能化的解决方案?在金融、法律、医疗、教育、政府等各行业的实践场景中,又有哪些大模型落地经验?「AI 前线」特别为您精选了刚刚结束的AICon 全球人工智能开发与应用大会上的精彩演讲,并经过嘉宾授权将演讲的精彩 PPT 提供给大家。关注「AI 前线」,回复关键词「行业创新」即可免费获取。

今日荐文

TikTok成立7年,罕见被曝全球大规模裁员!或波及一万人,用户运营团队直接解散

奥特曼昨晚放话也要把大模型价格打下来!微软一夜革新生产力:Copilot 贯穿全场、小模型持续炸街

13分钟颠覆传统电脑!微软Copilot+ PC 抢装GPT-4o、叫板苹果,网友不买账:用大炮打蚊子

老便宜了!字节跳动豆包大模型开始营业,一元钱能买125万Tokens,月活用户量达2600万

OpenAI 官宣旗舰模型 GPT-4o,完全免费、无障碍与人交谈!奥特曼:这是我们最好的模型

你也「在看」吗?