随着国内百度、阿里、讯飞等各大厂商陆续发布大语言模型,百模大战的态势愈演愈烈、一触即发。各类评测也纷纷登场,分析到底谁才是国产ChatGPT的“扛把子”。

评测榜单是技术圈常见的一个评估维度。不过,前提是榜单得是公开透明、且具有权威性,国内外行业巨头都参与并认可,榜单才具有公信力,否则就会成为一家之言,毫无说服力,甚至会诱导大众。近日,一份自称“中文通用大模型综合性评测基准SuperCLUE”发布,权威性待考证,存在三点较大疑问。

SuperCLUE而非SuperGLUE,啥啥分不清楚

众所周知,在国际NLP领域,有大名鼎鼎的数据集GLUE和SuperGLUE,非常权威,OpenAI、谷歌等的大模型都在上面评测,极大推动了NLP领域的发展。

这次这份SuperCLUE评测的发起方为Chinese GLUE组织 (简称CLUE),CLUE是仿照GLUE由国内民间组织的评测,权威度和影响力与GLUE相比差很远,其微信账号主体属性为个人。但这也迷惑了不少圈内人,GLUE和CLUE分不清楚,堪称李逵和李鬼。

从评测排名显示来看,刚发布的讯飞星火大模型在总榜单和子榜单中均排名第一位,仅次于人类排名和GPT-4、GPT-3.5。而国内发布最早、实力最强的文心一言却排在榜单最后。

2月翻车,4月卷土重来,心虚火速删除官网关联信息

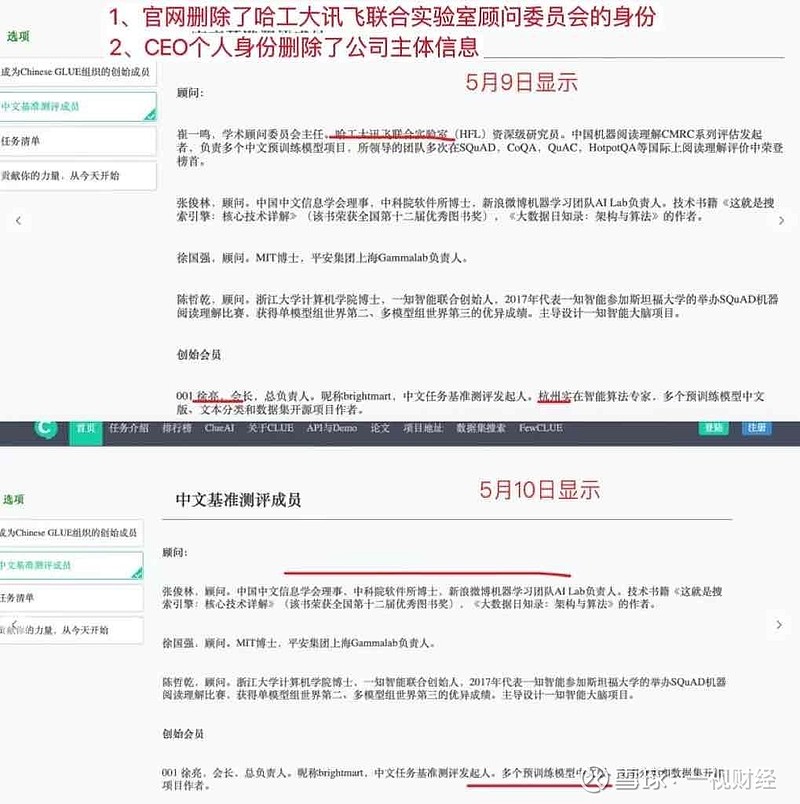

还有一点存疑,评测榜单发布当天5月9日,其官网显示信息,中文基准测评成员顾问中排名第一的是崔一鸣,身份为学术顾问委员会主任,哈工大讯飞联合实验室(HFL)资深级研究员。而5月10日,官网已删除此条顾问的信息。

而001号创始会员徐亮,是会长,相当于这个榜单的实际负责人。昵称brightmart,中文任务基准测评发起人。多个预训练模型中文版、文本分类和数据集开源项目作者。

徐亮曾在2月份发布自称“国内首个功能对话大模型ChatYuan”,不仅无法测试,发布几天即被监管叫停。4月,又被报道套壳推出开源组件。有分析人士认为,不排除创业公司有融资压力,蹭热度吸引投资人关注。

该SpuerClue榜单发起方,001号顾问是讯飞身份背景、001号基准发起人是创业公司创始人。在榜单发布后,担心行业质疑其公平、公正,相关信息还被删除。这就有点不言而喻了。

仅用100道评测题目就出来了一份“权威报告”

最后来说下这个榜单本身,业内人士一眼就可以看出来,评测的很不合理,首先,没有公布评估数据,以及具体的评估方式。同时从它的公开表述,可推断总共题目就100道题目。这个题目量少到难以置信。专业人士可能有参与过,像国际权威SuperGlue榜单,题目一般都得有2万多道,离权威可是差了几万倍。况且,它的评测得分榜首都是人类,那这个评分的基准到底是什么?是否有很多主观性因素在里面?是否某些大模型提前在这个数据集上已经训练过?

任务设计太武断,所谓“通用”基准,是用以测试通用的人工认知能力的,那么我们自然希望,评测任务是参考了模型想要模拟的认知能力及相关理论,系统化地选择出来的。而实际上,我们观察到的则是,基准的作者们在选择任务的时候,更像是图方便、省事。以往,CLUE 中存在着部分数据集,一味考虑任务的复杂性,却在最起码的分布边界划分上(如NER各个类别的边界,如场所、景点类,组织机构及其子类),模糊不清,且数据的一致性无法保证。

要么别比,要比就来点正规的比赛。自己出题自己考,说不准还抢跑,自己还是评委,那这是欺不负了解真相的吃瓜群众。投机取巧,终皆散去。苦练内功,才是王道。