利用AI来开发更小、更轻的XR眼镜

(映维网Nweon 2024年06月15日)如今的XR设备需要用头带固定沉重的光学器件和显示器,这不仅增加了体积,而且带来了社交障碍。在一个憧憬的未来里,头带将会消失。在过去的数年里,英伟达研究中心一直在与斯坦福大学戈登·韦茨斯坦教授(Gordon Wetzstein)领导的计算成像小组合作,探索如何开发更小、更轻的XR眼镜。

XR眼镜光学设计中最重要的规则是显示器应该更近,而图像应该看起来更远。随着显示器离眼睛越来越远,重心会发生变化,所以需要将显示器放置在靠近用户脸部的位置,以实现紧凑轻便的设计。

然而,人眼无法正确地感知太近的显示器,所以必须使用透镜等光学系统将图像传递到舒适的距离。为了确保系统有效,显示器需要位于透镜焦距附近,而这矛盾地要求显示器放置在更远的地方(下图)。

一种解决方案是使用折叠光路的Pancake透镜。然而,这种方法产生了新的问题,如畸变和额外的重量。光波导同时经常用于实现紧凑的XR眼镜,但它们存在自己的挑战,包括有限的视角和无限远的固定焦点。

XR全息眼镜

全息近眼显示技术作为一种能够克服相关限制的技术正在引起人们的注意。新的显示元件,例如空间光调制器SLM,它不是控制光的强度,而是控制光的相位,从而可以在SLM前后重建3D全息图。利用这一功能,即便显示器非常靠近透镜,3D图像都可以定位在焦距附近。

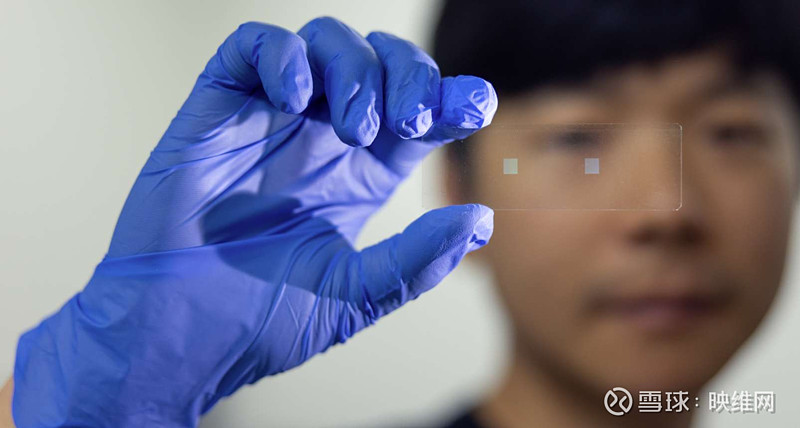

利用这一原理,英伟达和斯坦福大学推出了仅2.5毫米厚的全息眼镜(下图)。有了波导、全息近眼显示器和几何相位透镜,这种眼镜可以用最小的厚度制造,不需要自由空间传播。团队实现了用于测试的台式和可穿戴原型。

所提出的双目可穿戴样机支持3D焦点线索。它提供了22.8度的对角线视场,2.3毫米的静态视窗和带有光束转向的动态视窗的附加功能,而重量仅为60克。利用用户瞳孔作为自然傅立叶过滤器的想法,团队首次展示了真正的眼镜形态全息VR。

延伸阅读:斯坦福、港大、英伟达研究员用全息术+先进纳米光子学,实现真正普通尺寸AR眼镜

网页链接

映维网早前已经对这项研究进行了一定的分享,而英伟达日前再通过博文进行了进一步的介绍。这种特别的眼镜结合了反设计的全彩超表面光栅,紧凑的色散补偿波导几何形状和人工智能驱动的全息算法。

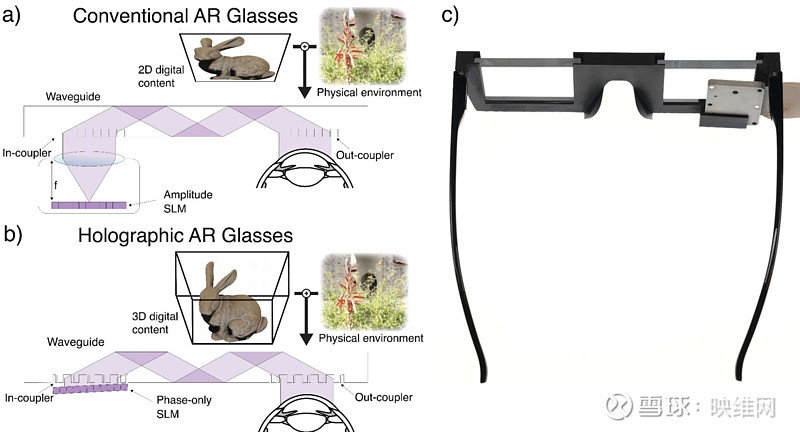

采用与之前研究类似的方法,团队从光路中消除了透镜,并策略性地使用全彩超表面光栅作为耦入器和耦出器。如下图所示,传统的AR眼镜使用振幅SLM,如有机发光二极管或微发光二极管,这需要一个基于投影仪的光引擎,通常至少与投影透镜的焦距一样厚。

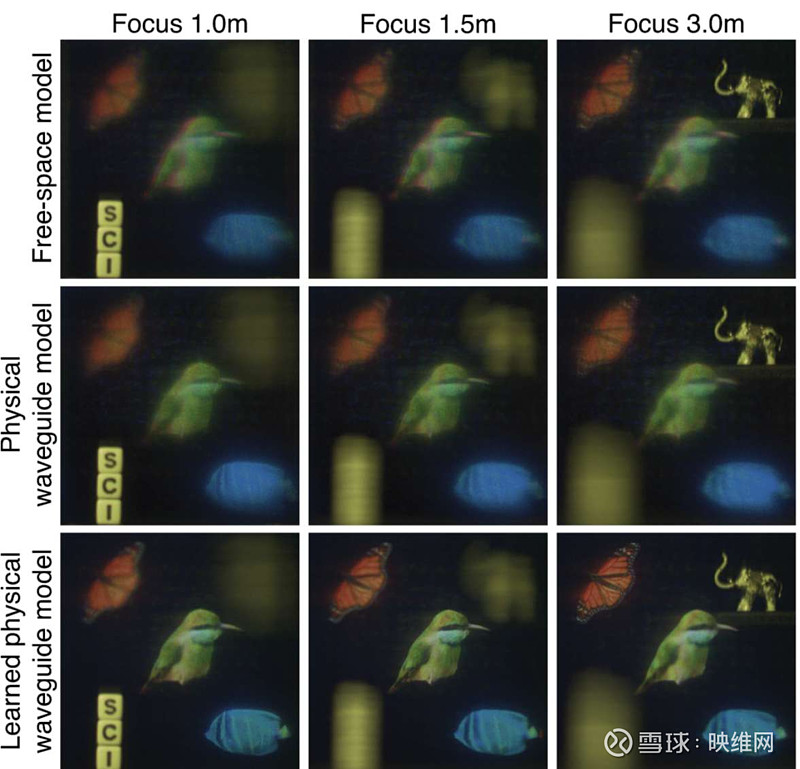

英伟达和斯坦福的全息AR眼镜设计使用了一个纯相位SLM,可以安装在非常靠近耦合光栅的地方,从而最大限度地减少了设备的形状参数。与传统的AR眼镜不同,团队的全息设计可以为虚拟内容提供完整的3D深度提示。下图显示了通过紧凑全息显示样机捕获的实验结果。这项创新的研究是第一次在完全透明的玻璃结构中成功实现全彩色3D全息。

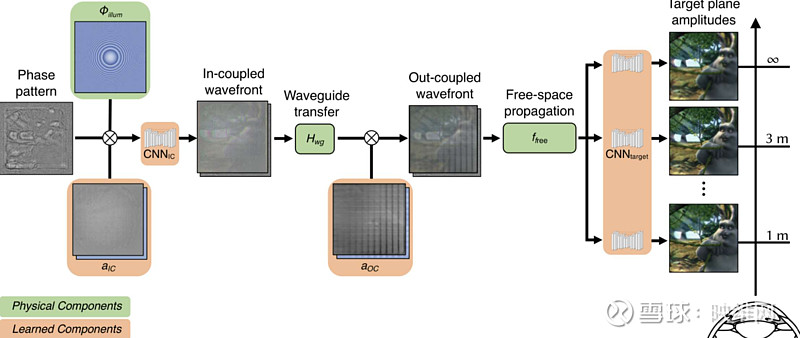

设计的另一个重要特点是使用人工智能驱动的全息算法,这使得使用之前推出的紧凑轻便的全息XR眼镜成为可能。SLM由相干光源供电,如激光,其中波导系统中相干波前的精确操作对于全息显示至关重要,但由于相干光的干扰性质,这非常具有挑战性。为了应对这一挑战,研究人员开发了一个数学模型,使用物理精确建模技术和人工智能相结合来描述波导中相干波的传播。

如下图所示,当在捕获的数据集之上训练时,学习的参数使得模型能够准确地预测全息AR眼镜的输出,并在运行时计算目标场景的相位模式。

模型完全可微,使简单的梯度下降计算机生成全息算法能够在运行时计算目标场景的相位图案。

模型可以通过神经网络组件参数化,而神经网络组件可以从摄像头反馈中自动学习。在实际的全息显示器中,即便是波长尺度的偏差都会导致图像质量的显著下降,这使得人工智能驱动的校准至关重要,特别是在波导等复杂结构中。所提出的波传播模型可以准确地代表了物理光学,而与其他模型相比,它显著提高了图像质量。

英伟达指出:“人工智能已经令实用的全息显示成为可能,并使创建支持焦点提示的3D XR眼镜成为可能。这一研究领域为人工智能在显示器上的应用开辟了全新的可能性。尽管人工智能已经用于内容创作和人机交互,但它同时可以显着减少显示器本身的尺寸和重量。这是一项超越传统期望的突破性成就。”

---

原文链接:网页链接