2024-04-05 15:51

要点

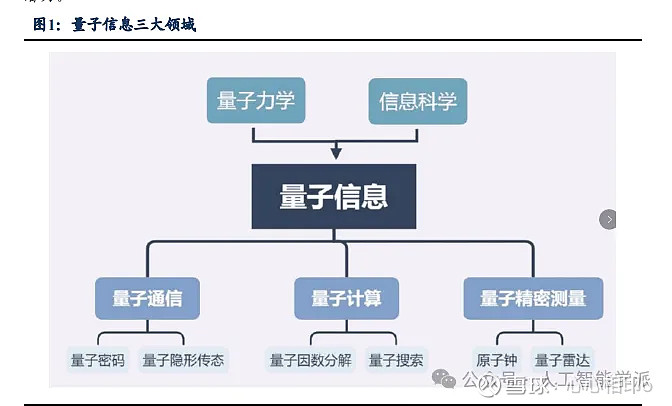

量子信息是量子力学与信息技术的交叉,主要包括量子计算、量子通信和量子测量三大领域。

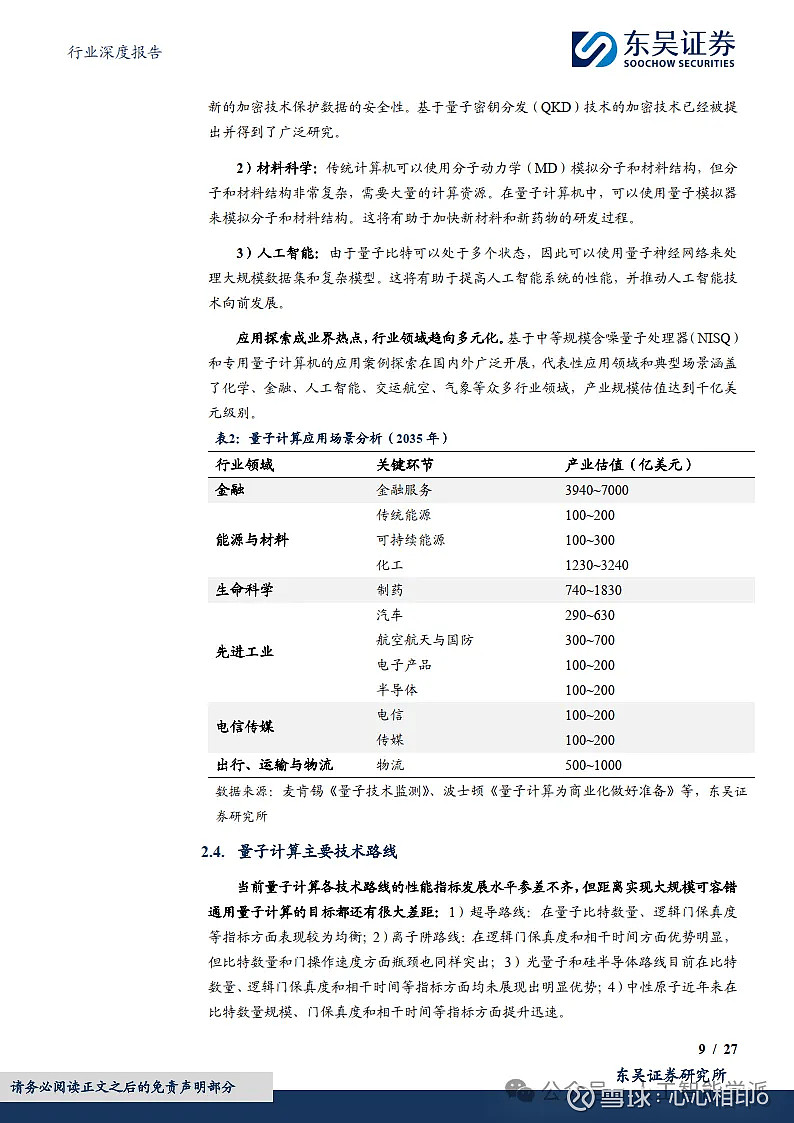

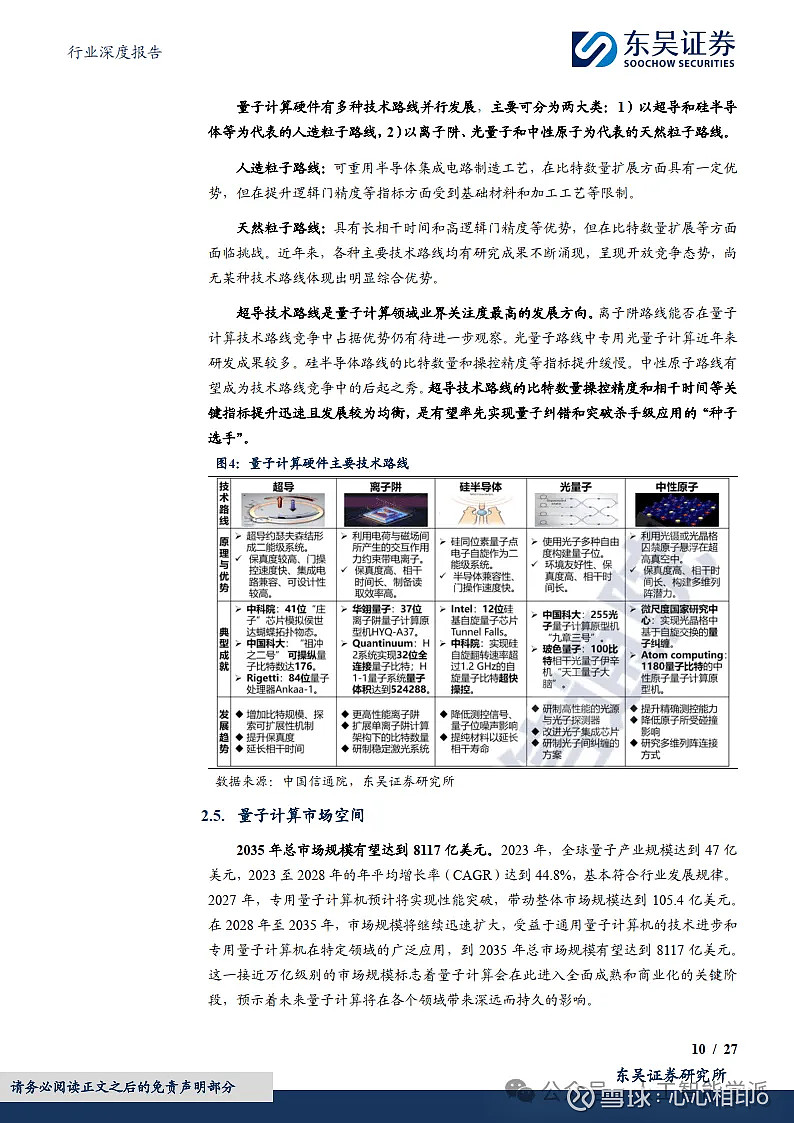

量子计算:量子计算是量子信息颠覆传统信息技术最核心的领域。利用量子的叠加和相干性,量子计算可以实现相比于传统计算机指数级别信数的计算能力。但现在量子计算技术尚未成熟,超导、离子阱等各种技术路线尚未收敛。当前量子计算机主要应用一些特定领域,乐观地估计,十到二十年之后,可以制造出普适的“通用量子计算机”。2023 年全球量子计算市场规模约为 47 亿美元,2035 年有望达到 8117 亿美元。产业链包括上游的环境支撑系统、测控系统、各类关键设备组件以及元器件等,是研制量子计算原型机的必要保障。产业中游主要涉及量子计算原型机和软件,其中原型机是产业生态的核心部分。产业生态下游主要涵盖量子计算云平台以及行业应用。

量子通信:量子通信利用量子的纠缠性、不可复制性等特性实现加密信息传输。量子通信主要包括量子密钥分发、量子隐形传态和量子保密通信网络三种技术。量子密钥分发(OKD)确保任何企图窃取传送中的密钥都会被合法用户所发现,是商业化进程较快的细分方向。量子隐形传态和量子保密通信网络仍处于技术研发早期。量子通信方面,中国已经建设了局域网、城域网、广域网和量子通信卫星等工程。量子通信产业链上游为元器件及核心设备:中游为网络传输线路及系统平台;下游消费市场,应用于军事国防、电子政务、电子商务、能源电力、电子医疗、电信运营等领域。2030年全球量子通信市场规模为196.8亿美元

量子测量:量子测量利用量子系统对外部干扰的强烈敏感性来对物理量进行精密测量。量子测量各技术方向的发展成熟度有较大差异,既有原子钟、原子重力仪等已成熟商用产品,也有量子磁力计和量子陀螺等处于早期的样机产品,还有量子关联成像、里德堡原子天线等尚处于系统技术攻关的原型机。量子测量产业链上游主要是系统研发所需的基础材料、元器件和支撑系统提供。中游包含各种技术方向的系统设备提供商,下游涉及基础科研、国防军工等诸多领域。全球量子精密市场规模预计从 2019 年的 11.2 亿美元增长到 2030 年的 25.27 亿美元,市场规模呈现不断上升趋势,年复合增长率为7.97%。

量子信息:量子力学与信息技术的交叉

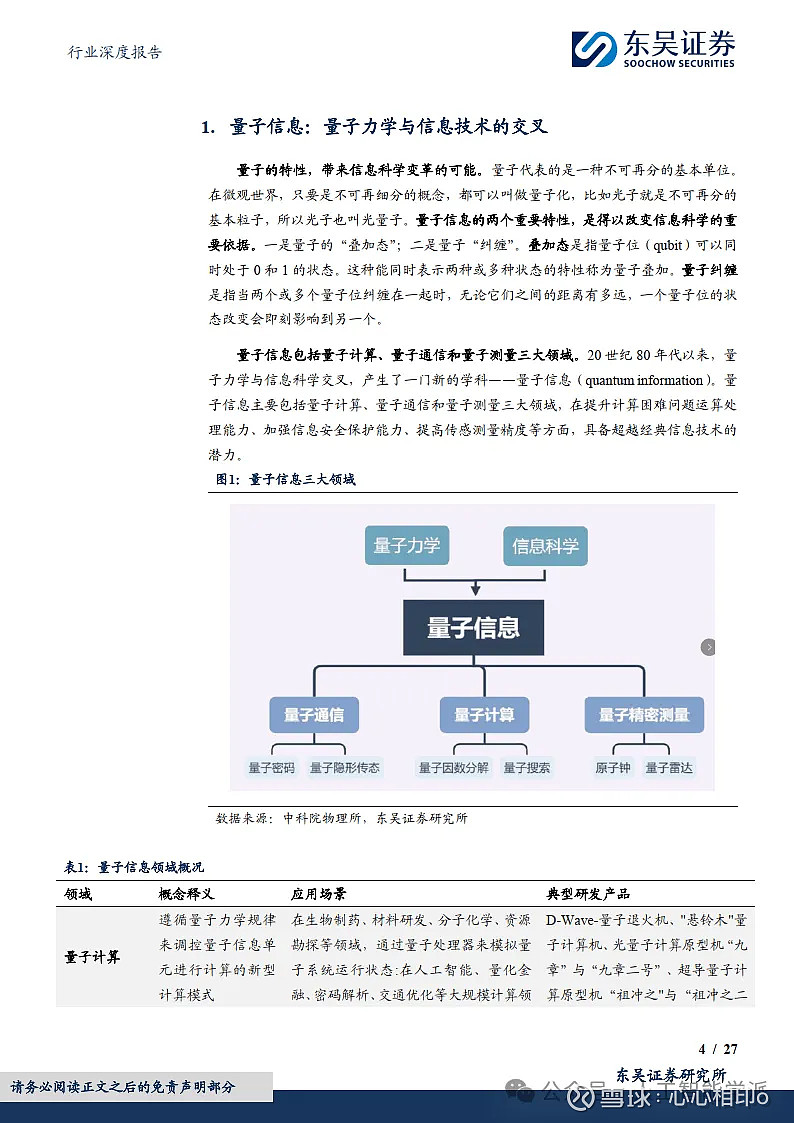

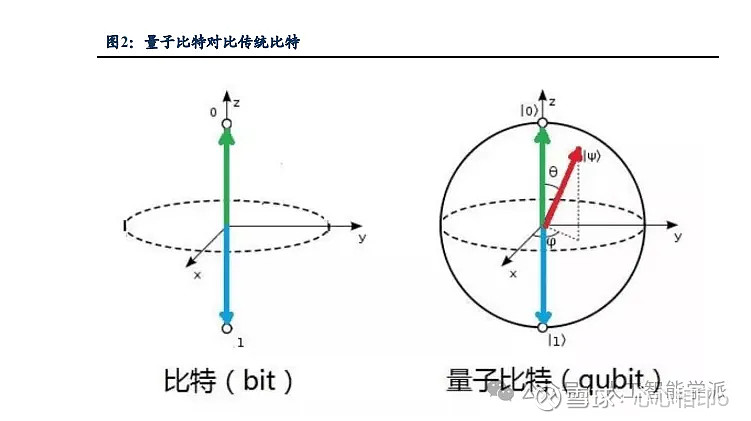

量子的特性,带来信息科学变革的可能。量子代表的是一种不可再分的基本单位在微观世界,只要是不可再细分的概念,都可以叫做量子化,比如光子就是不可再分的基本粒子,所以光子也叫光量子。量子信息的两个重要特性,是得以改变信息科学的重要依据。一是量子的“叠加态”;二是量子“纠缠”。叠加态是指量子位(qubit)可以同时处于0和1的状态。这种能同时表示两种或多种状态的特性称为量子叠加。量子纠缠是指当两个或多个量子位纠缠在一起时,无论它们之间的距离有多远,一个量子位的状态改变会即刻影响到另一个。

量子信息包括量子计算、量子通信和量子测量三大领域。20世纪80年代以来,量子力学与信息科学交叉,产生了一门新的学科--量子信息(quantuminformation)。量子信息主要包括量子计算、量子通信和量子测量三大领域,在提升计算困难问题运算处理能力、加强信息安全保护能力、提高传感测量精度等方面,具备超越经典信息技术的潜力。

量子计算的定义与优势

量子计算按照既定的算法和程序,对量子态进行操控和测量的过程。量子态的演化过程,对应的就是一个量子计算过程。量子计算是量子信息技术的核心。没有量子计算,量子技术其他领域的发展,不足以动摇现有信息技术的根基。

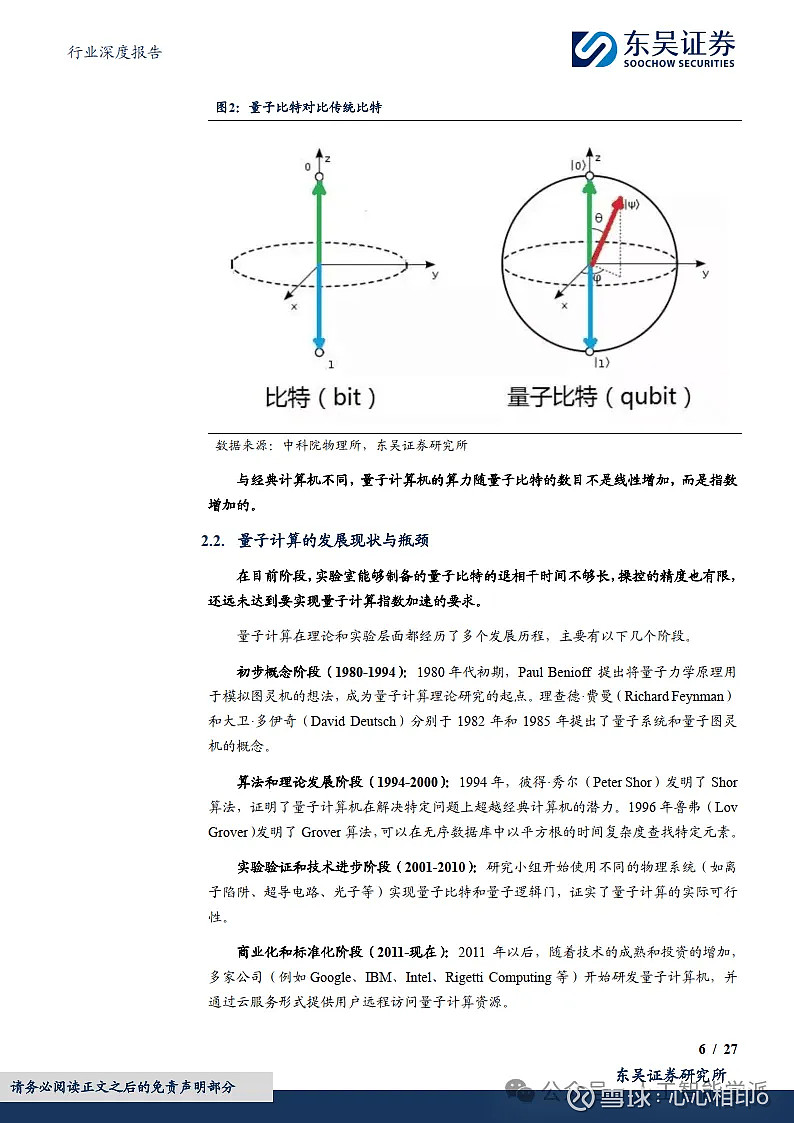

量子计算利用的是量子叠加的特性。多个量子比特与同样数目的经典比特比较,差别是指数级的。N个经典比特一次表示的数字只有1个,N个量子比特一次能表示的数字数目为 2的N 次方。当 N=250 时,可以表示的数字数目比宇宙中所有原子的数目还要多。

量子计算以量子比特为基本单元,对传统计算机来说,两个比特能表示四个数,也就是 00、01、10、11,但某个具体的时刻只能有一个值。但对于两个量子比特,这四个值可以同时存在。随着量子比特数的增加,能同时表示的数也会指数级的增加,N个量子比特就可以同时有2的N次方个值,这就相当于在同一个时刻,可以进行2的N次方个运算。

与经典计算机不同,量子计算机的算力随量子比特的数目不是线性增加,而是指数增加的。

量子计算的发展现状与瓶颈

在目前阶段,实验室能够制备的量子比特的退相干时间不够长,操控的精度也有限,还远未达到要实现量子计算指数加速的要求。

量子计算在理论和实验层面都经历了多个发展历程,主要有以下几个阶段。

初步概念阶段(1980-1994):1980年代初期,Paul Beniof 提出将量子力学原理用于模拟图灵机的想法,成为量子计算理论研究的起点。理查德·费曼(RichardFeynman)和大卫·多伊奇(David Deutsch)分别于 1982 年和 1985 年提出了量子系统和量子图灵机的概念。

算法和理论发展阶段(1994-2000):1994年,彼得:秀尔(PeterShor)发明了Shor算法,证明了量子计算机在解决特定问题上超越经典计算机的潜力。1996年鲁弗(LoVGrover )发明了 Grover 算法,可以在无序数据库中以平方根的时间复杂度查找特定元素,

实验验证和技术进步阶段(2001-2010):研究小组开始使用不同的物理系统(如离子陷阱、超导电路、光子等)实现量子比特和量子逻辑门,证实了量子计算的实际可行性

商业化和标准化阶段(2011-现在):2011年以后,随着技术的成熟和投资的增加,多家公司(例如 Google、IBM、Intel、Rigetti Computing等)开始研发量子计算机,并通过云服务形式提供用户远程访问量子计算资源。