#雪球星计划# 根据外媒爆料,微软$微软(MSFT)$ 内部正在开发自家首款5000亿参数的大模型MAl-1。其规模远超出微软此前推出的一些开源模型,在性能上或能与谷歌的Gemini 1.5、Anthropic的Claude 3和OpenAI的GPT-4等知名大模型相匹敌。

还有人给出预计称,,MAI-1最快在5月举行的微软Build开发者大会上预览这款新模型,具体取决于未来几周开发情况。

肯定很多人不理解,微软不是拿了100多亿投资了OpenAI,那OpenAI搞出来的大模型GPT-3.5/GPT-4不是想用就用,还真不是。

此前就有传言称,微软已经沦落为OpenAI的一个IT部门。

或许微软也意识到别人的东西终究不是自己的,毕竟用别人的东西是要人家脸色的,还是用自家的才能有控制权。

微软要搞自己的大模型,早有苗头。

微软支付6.5亿美元收购了Inflection的知识产权,并聘请了该公司前首席执行官Mustafa Suleyman,亦是谷歌DeepMind联合创始人Mustafa Suleyman为Microsoft AI的负责人,同时雇佣了Inflection的几名员工。

在此简单介绍下Inflection,该公司成立于2022年,并成功推出了大模型Inflection(目前已更新到了2.5版本),以及日活破百万的高情商AI助手Pi。

虽然没有找到合适的商业模式,但微软看中的是Inflection在大模型上的技术、数据和经验,因此高价进行了收购。

不过,这并不代表MAI-1就是从Inflection模型继承而来。根据微软自己的说法,MAI-1可能借鉴了Inflection旗下模型的部分技术,但自研部分更多,因为MAI-15000亿的参数规模将远远超出,微软以往训练的任何小规模开源模型。

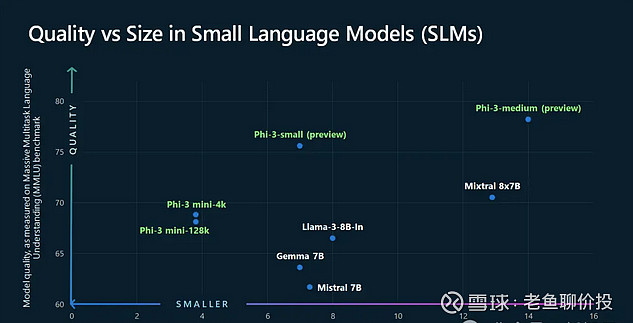

其实就在一个月前,微软刚推出了一款名为Phi-3的小型AI模型,其中Phi-3 mini被优化至可部署在手机上,拥有38亿参数。

对比来看,MAI-1规模要大得多,这也意味着其将需要更多的算力、数据,训练成本也是高昂的。

4月初,有报道称微软计划到今年年底前囤积180万块AI芯片,意味着公司希望在2024年内将所持有的GPU数量增加两倍。从2024财年到2027财年(到2027年6月30日结束),微软预计将在GPU和数据中心上花费约1000亿美元。

看了微软是铁了心要搞自己的大模型了。

那这是否代表微软就不要OpenAI,目前看来不会。GPT-4曾被曝出有1.8万亿参数,MAI-5000亿的参数,距离GPT-4还有一段距离要追赶,况且自研跟OpenAI合作并不冲突,两条腿走路总比单条腿走路要稳得多。

就在前段时间,外媒还曝出了微软和OpenAI联手打造AI超算“星际之门”,将斥资高达1150亿美元,最快将在2028年推出超算,并在2030年之前进一步扩展。

如果这个消息属实的话,那微软与OpenAI的关系至少在六年内的合作性质不会改变。

况且大模型推出来只是开始,微软还未明确MAI-1模型的确切用途,具体取决于模型效果如何。

或许在即将到来的微软Build开发者大会上,我们有望得到关于MAI-1更多的信息,那咱们就坐等MAI-1发布吧!