英伟达在GTC大会发布的超级芯片系统命名为GB200,据悉GB200将全部采用800G交换机、800G光模块和800G连接器,相关上市公司订单已排到明年。

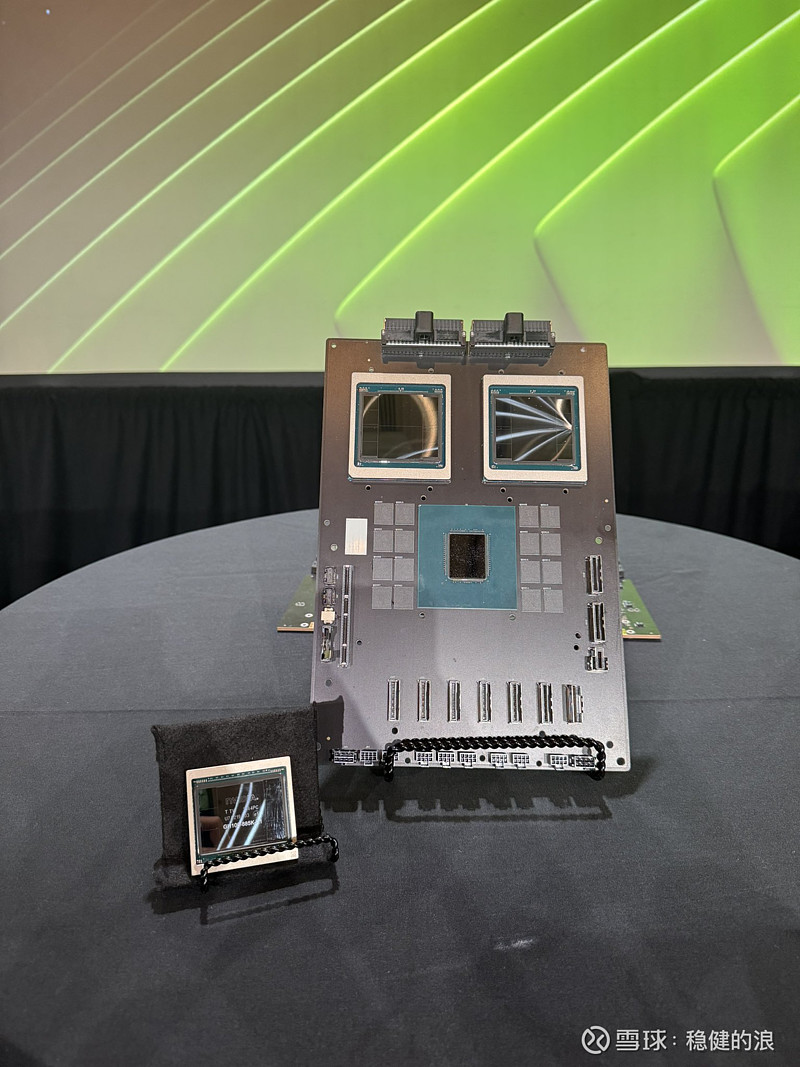

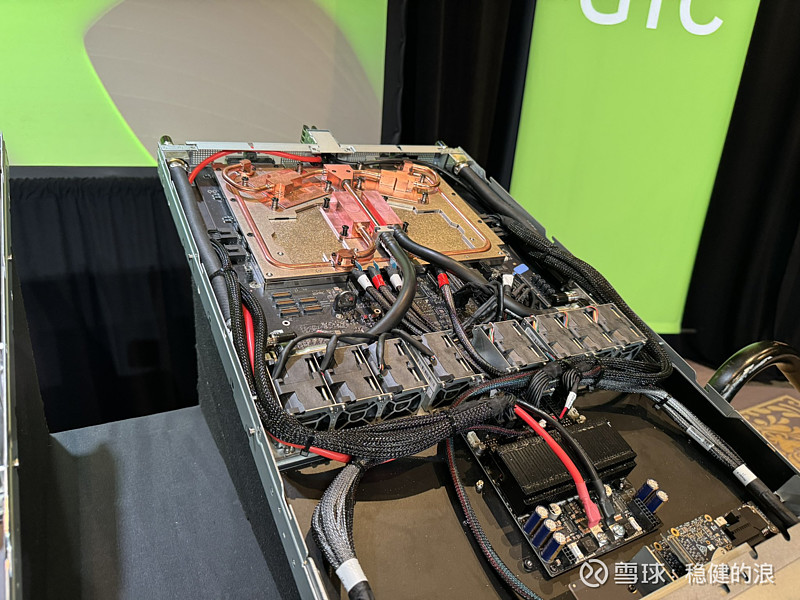

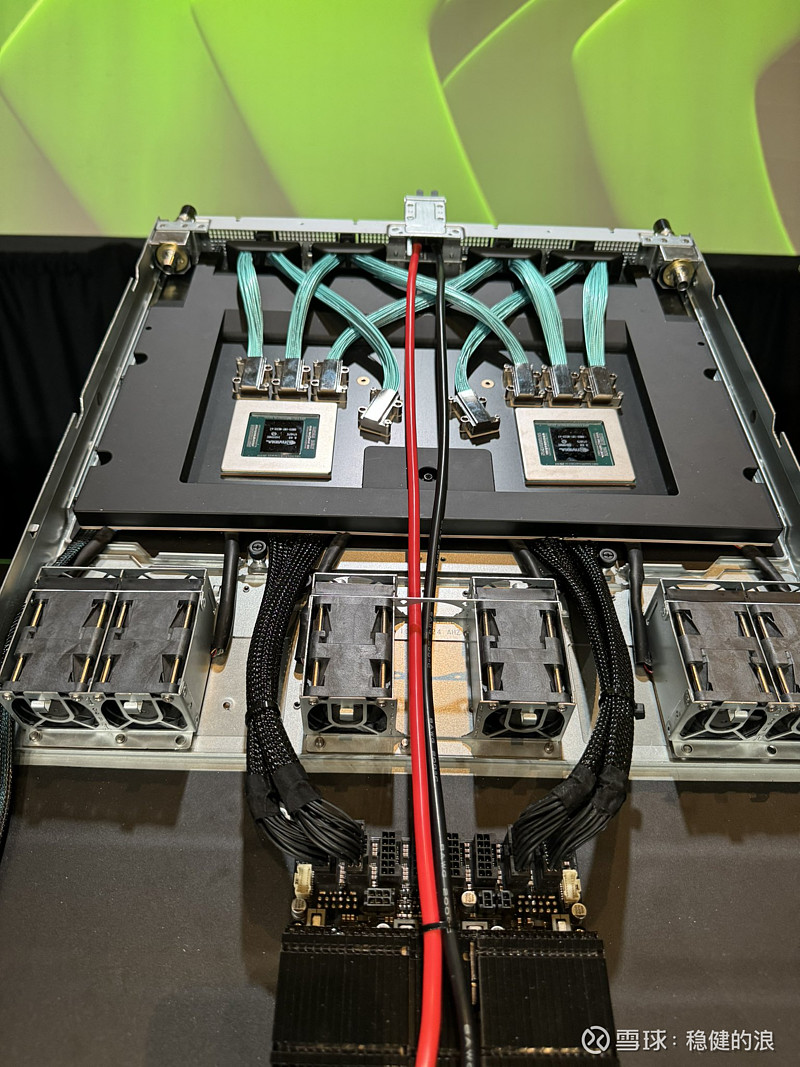

我们通过仔细搜索各大平台和AI工具的帮助获取到GTC展会的一些现场实拍照片,可以近距离看到英伟达GB200的更多细节。

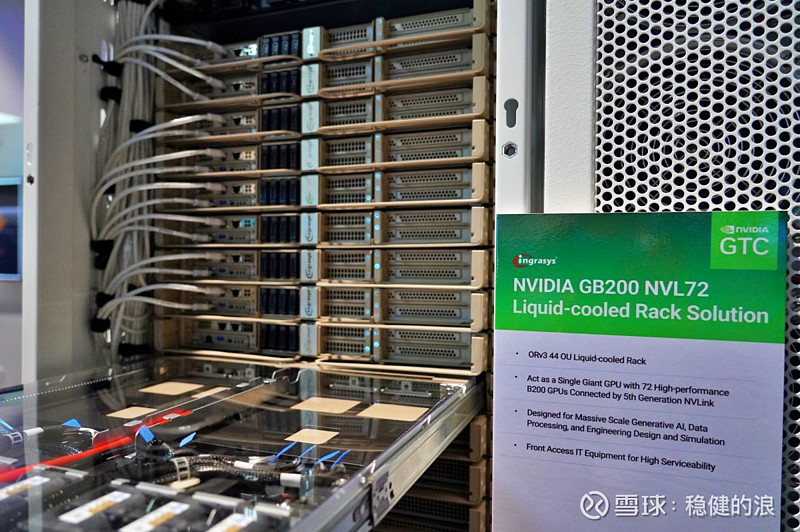

机柜中的每个机架包含两个GB200芯片,或两个NVLink交换机。一共有18个GB200芯片托盘,9个NVLink交换机托盘。

可以看到该机柜最顶上两台800G的光模块交换机,72*2=144个端口。背面也有同样的两台交换机,也有144个端口。总共 288个800G的端口。这一台机架内部的800G光模块数量 = 288*2 = 576颗。而这个机架里面的芯片只有72颗。

芯片 : 光模块 = 1:8。

配比上采用1个CPU+2个GPU,单个机柜内部可容纳72个GPU。

全新B200 GPU拥有2080亿个晶体管,采用台积电4NP工艺节点,提供高达20 petaflops FP4的算力。与H100相比,B200的晶体管数量是其(800亿)2倍多。而单个H100最多提供4 petaflops算力,直接实现了5倍性能提升。

针对单颗GPU,采用192GB HBM3e,8TB内存带宽配比关系:若采用1.6t光模块,预计比例会提升。单卡双向传输带宽达到1800GB,单向对应900GB。

互联模式采用NVSWITCH,NVSWITCH:采用台积电4nm工艺,72端口(双向200G serdes),NVLINK带宽达到1.8TB,GPU和NVSWITCH之间采用铜互联,同时搭配IB交换机进行网路互联。

老黄很贴心,知道各个搞大模型的公司,不会一卡一卡地买。

所以老黄将36个Grace CPU和72个Blackwell GPU封装到一个液冷机架中,取名叫GB200 NVL7。可实现总计720 petaflops的AI训练性能,或是1,440 petaflops(1.4 exaflops)的推理性能。

不得不提的是,它内部共有5000条独立电缆,长度近两英里。

光是这么长的电缆,还是值很多很多钱的!所以,GB200 NVL7肯定不便宜。

另外,现场看到英伟达GB200的液冷机架方案是由鴻海(Foxconn)的子公司鸿佰提供的。

看了这么多,GB200性能全面提升已经是板上钉钉了,尤其在推理端性能提升明显,对于GPT万亿模型参数,在FP4计算格式上,GB200的效果是H100的约30X。目前GB200的生态合作伙伴不断扩大,包括AWS、谷歌、微软、甲骨文等,相较于GH200,GB200有望大幅放量!

对老黄来说,最关键的就是:

卖卡,

卖很多卡(机柜),

打包卖很多很多卡(数据中心)。

我,英伟达,打钱!