博通:高效整合的平台型科技巨头。

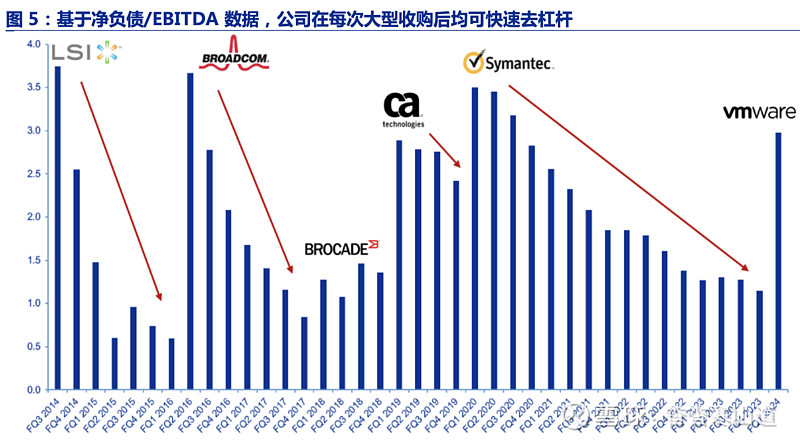

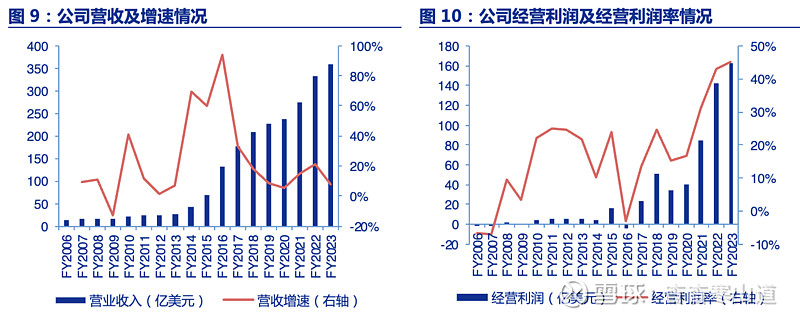

公司是全球通信芯片领军企业,注重外延扩张,通过“收购优质标的+舍弃部分业务”循环实现增长,并多次于收购后短时间内降杠杆提升整体盈利能力。公司在2010年、2014年、2016年的三次营收增速上升节点以及ROE转折点,分别在对Infineon、LSI、老博通的三次重大收购事件之后,证明其高效整合能力;公司18年前并购集中在半导体领域,18年后拓展到软件,并购VMWare后(并表10.5周)FY24Q1软件业务收入占比38%,半导体解决方案收入占比62%。

半导体解决方案有望长期受益于AI浪潮:

(1)网络:以太网接力AI算力成长。AI驱动下,网络与算力强耦合,网络需求与算力需求共进退。趋势上,以太网与InfiniBand将逐步分化形成互补格局,在AI Cloud/AI Factor y环节扮演不同作用;而AI产业长期发展由训练为主转向训推并重,以太网高适配性及经济性优势或将凸显。博通具备完整、领先且稀缺的交换芯片-NIC-DSP-光学收发器产品线,网络各环节覆盖形成产业链强话语权;技术研发能力内生增长、SerDes IP等核心通信技术保驾护航;多维度优势支撑博通匹配AI算力爆发下网络需求。据公司FY24Q1业绩会指引,预计2024财年网络收入将同比增长35%以上。

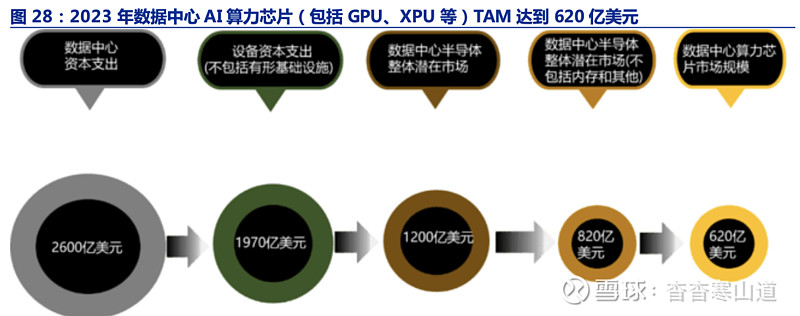

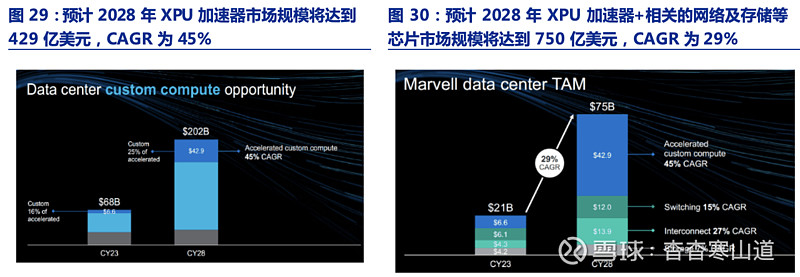

(2)XPU:受益科技巨头自研芯片趋势,博通具备丰富开发资源+经验。云厂商、AI应用及大模型公司降低算力成本、保证供应安全的背景下,XPU使用比例提升趋势明确,Mar vell估计2028年市场空间或超过400亿美元。依托丰富的IP核以及多年XPU设计经验,博通深入参与XPU研发的众多配套环节。公司披露,截至24年3月公司已拥有谷歌在内的3家XPU客户。据公司FY24Q1业绩会指引,24财年半导体业务 中AI驱动收入占比将达35%,AI总收入预计超过100亿美元,其中AI加速器的占比约为70%,网络及光学等其他组件占比将为30%,也即24财年单XPU业务将为博通带来近70亿美元的营收。

基础设施软件:收购VMWare,软硬一体再上台阶。

博通软件业务23财年运营利润率75%,保持较高盈利水平。销售体系 复用+剥离非核心业务+提 升订阅制比例为博通 收购整合软件公司 的 成功 法则 ,正 在VMWare上 复制 。VMWare是 虚拟 化和 混合 云领 军企 业,2021年VMWare在全球和中国境内非公有云虚拟化软件市场的份额分别为超过90%和超过20%。据博通FY24Q1业绩会指引,VMWare的收入在本财年后续季度环比增长将超两位数,2024财年软件业务实现约200亿美元收入。2023年以来VMWare积极布局生成式AI,推出Private AI。收购VMWare不仅能提升整体盈利水平,还可软硬一体助力构建部署在私有云的高性能软件定义数据中心;

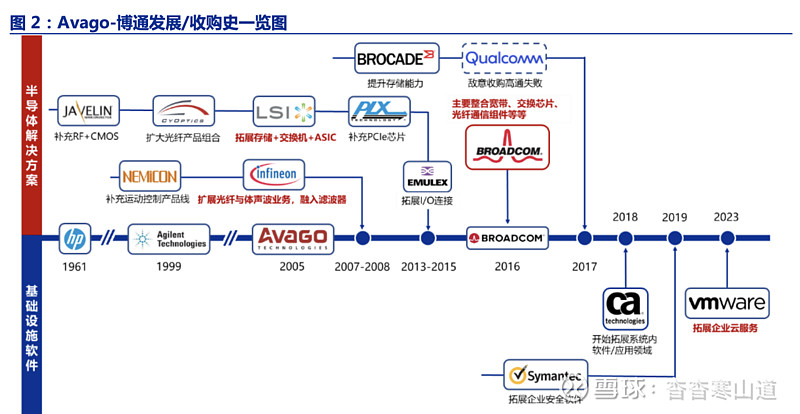

博通是一家以半导体技术为基石,由多项半导体及软件分业务组合而成的平台型公司。公司具备 超60年半 导体技 术积淀 ,前 身最早 可追溯 到1961年成 立的惠 普半导 体产品 部门 。1999年,该部门 从惠普 分拆出 来,成 为安捷 伦科技(Agilent Technologies)的一部 分。2005年,KKR 和Silv er Lake Partners 以26.6 亿美元收 购安捷 伦科 技的半 导体事 业部,成立安 华高科技(Av ago Technologies),新公司 于2009年在 纳斯达 克上市 。2016年,安华 高科技“以小博大” 以370亿美 元收购 博通,整 合后公 司定名“ 博通” 直至今 日。当前公司主要分两块业务:半导体解决方案及基础设施软件

资本运作积极,通过激进外延收购拓宽能力边界、实现前瞻布局。公司 的发展 史可 近似看作一部业 务收购+整合史 ,2017年前以补充+拓 展半导 体各业 务能力 为主 ,2017年收购高通失败后转 向软件 业务收 购。公 司收购 风格激 进,包 含数次 “蛇 吞象” 型收购 ,包 括2013年公司在市值 为120亿 时以66亿美元 收购LSI,2015年以370亿美 元收购 老博通 等。公司的 基础设施软件 业务亦 是通过 收购CAtechnologies和Symantec后整 合而成 。值得 注意的 是,包括RF滤 波器、ASIC定制 芯片、交换机 芯片等 公司 产品/子业 务均在 相关业 务收购 后3-5年迎 来行业机会,实 现高 速发展。其中,RF滤波器等在智 能手机 上的应 用奠定 了博通 与苹果 的长期 深度合作。苹果是博通的第一大客户,22财年博通来自苹果的营业收入占总收入的约20%

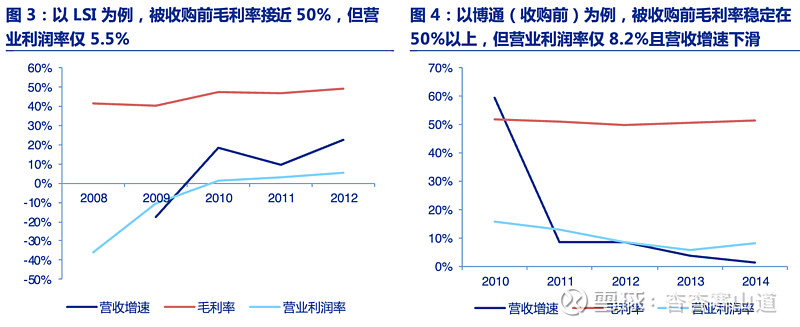

业务“投资组合”管理模式,通过“收购优质标的+舍弃部分业务”循环实现增长。在总裁兼CEO HockTan的 视角内 ,公司 多元化 的业务 更接近 于投资 组合。在 其治理 下,公司 倾向于主动 收购优 质标 的以构 建多 元全面 的业务 矩阵 ,其收购标的特性包括细分行业领军企业、毛利高但运营费用过高、净利和现金流低于潜在水平等, 此类 标的具 备较 强技术 积累 但运营 能力弱,纳入博 通的大 平台后 往往可 实现“1+1>2”的效 果。同时 公司通 过收购 替代研 发支出 等费用,并 果断售 出低 毛利、 发展 前景普 通的业 务以 快速去 杠杆 ,维持 财务 健康, 积累 资金推 动下次收购,以此实现正向循环。

历史数据表明收购显著推动估值抬升,AI浪潮下公司股价涨幅领先。自2013年底 至24年3月底,公 司股价 涨幅累 计达3164%,持 续跑赢 大盘 。其中 收购案 件是股 价增长 重要驱 动因素之一, 例如在 对LSI和 老博通 的收购 完成后 ,股价 于一年 内涨幅 分别 达75.9%与50.2%。此外,2022年11月30日C hatGPT正 式发布 、AI浪潮开 启后 ,截 至24年3月底公 司股价 涨幅累计达149.2%,相 同时间 段内 相比 “科技 七巨 头” (苹果 、微 软、特 斯拉 、英 伟达、M eta、谷歌、亚马逊)涨幅仅次于英伟达 与Meta。24年 三月底 公司总 市值已 超过6000亿 美元

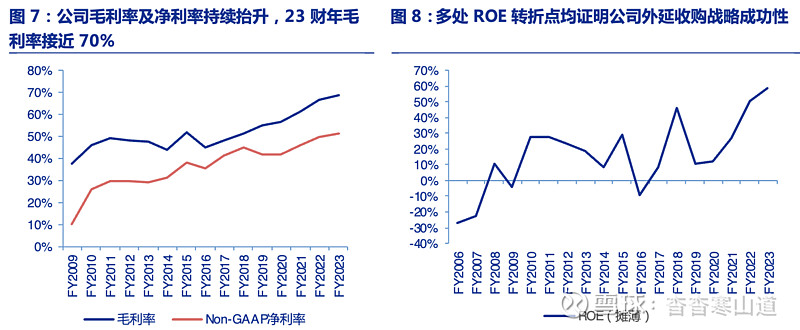

财务分析:利润率亮眼,收购软件公司后公司年度毛利&净利持续上升。基于 多次 对高毛利标的 成功收 购以 及持续 性优 化结构 、削减 费率 ,公司 的毛 利率及 净利 率维持 高水 平。通 过收购高毛利 软件业 务,公 司 近3年 毛利率 持续上 升,23财年已接 近70%;收 购前由 于运营 费用高,CA technologies、VMWare等公 司净利率均未 超过20%,但收购 后得益 于有效 平台整 合,公司整体净利率仍持续上升,23财年N on-GAAP净 利率突 破50%。

多处业绩加速/转折与收购强相关。公 司在2010年、2014年、2016年的三 次营收 增速上升节点以及ROE转折 点,均 分别在对Inf ineon、LSI、老博通的三次 重大收 购事件 之后, 此亦说明公司历史上战略收购的成功性。

边际上,预计AI驱动及VMWare收入贡献将成催化剂。分季度 来看,成 功收 购VMWare后,FY24Q1基础设施 软件业务收入46亿美 元,同 比增长156%,其中VM Ware贡献21亿美元。据 公司FY24Q1业绩会 预测,V MWare的收 入在本 财年后 续季度 环比增 长将超 两位数;24财年半导体业务中AI驱动收入占 比将 达35%,AI总收入预计超过100亿美 元

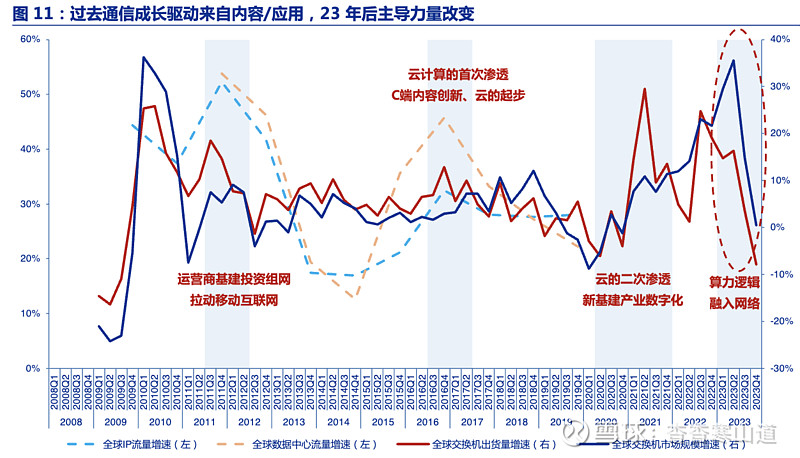

通信网络价值的主导力量转换:历史上内容/应用驱动的流量逻辑,延伸至AI训练/推理驱动的算力逻辑。复盘历 史上多 轮通信 网络周 期,22年以 前下游 驱动主 要来自互联 网与云,具体体现为To C的内容或 应用创 新与运 营商建 设周 期相结 合,通信 网络在 其中体 现流量 管道属 性。然而23年起,ChatGPT引 领算力需求爆 发,大 模型训 推成行 业主要 驱动力 ,网络 技术的 演进路线转向,网 络与算 力需求 相匹配 。简 言之,网络与算力强耦合,网络需求与算力需求共进退,这是当前通信网络环节最大的边际价值;

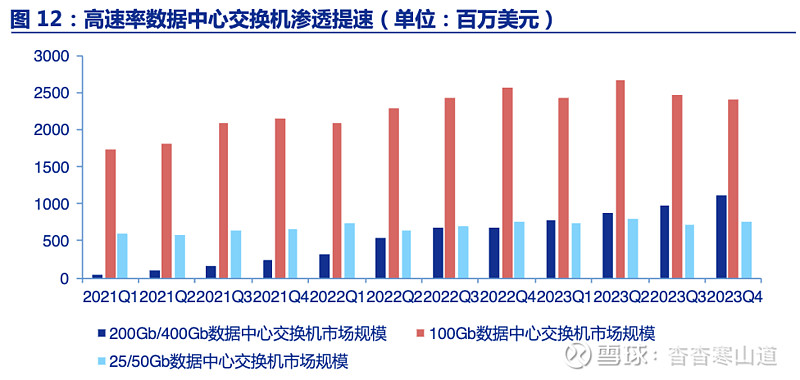

AI对网络需求:IC T -光通信-IDC环环紧扣,边际持续提速;高速交换机增长是行业主要驱动力。英伟达AI芯片加 速迭代以及云 服务厂 商资本 支出的 增长趋 势,体 现出2024-2025算力( 训练+推理 )供 给与 需求 的强 匹配 预期 ;与 之对 应的则 是算 网耦 合大 趋势 下, 交换 机、服务器、光 模块等底层硬 件近 似同步迭代,以支撑网 络技术 演进(供 给)加 速。以交 换机为 例,据IDC数据 ,2023年全年, 数据中 心板块200/400Gb交换 机收入同比增长68.9%,4Q23环比增长14.8%;而100Gb数据中心交换机全 年同比增长6.4%,4Q23环 比下 降3.0%。

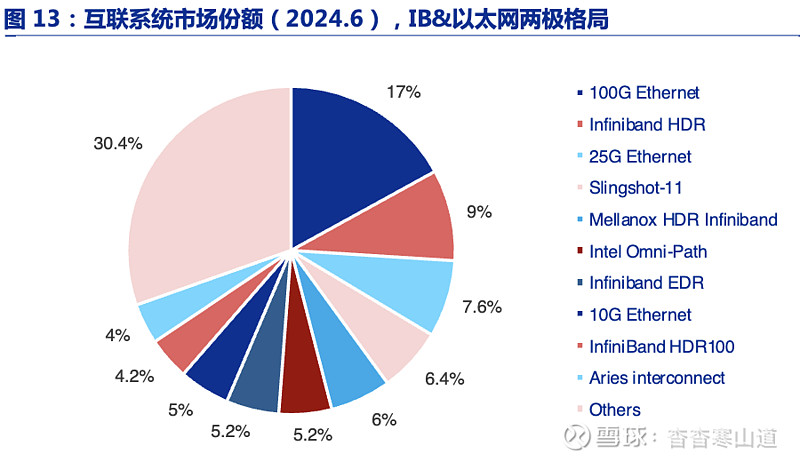

架构上,以太网代表阵营与InfiniBand代表阵营的网络演进,是市场和产业重要分歧:市场普遍 关注以 太网(Ethernet)及Inf iniBand两种不 同架构未来主 导地位 及市场 份额。我们认为,未来两者将逐步分化形成互补格局,在AI Cloud/A I Fac tory环节扮演不同作用,类似公有云/私有云、通用/定制软件、黑盒/白盒之争,AI算力浪潮下均有增量机会;

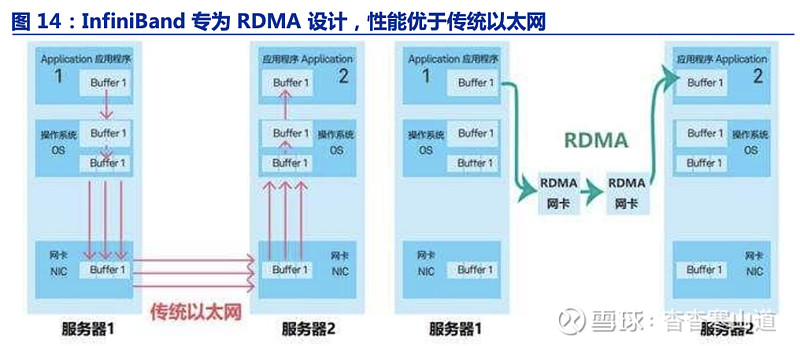

从设计初衷出发,以太网近似日常道路后期改建升级,InfiniBand近似直接搭建高速公路。通用的以 太网标 准早 在1980年已推 出,用 于将多 台计算 器或其 他设备(如打 印机、扫描仪 等)连接 到局 域网,因 此主 要考 虑系 统之 间传 输信 息的 兼容 性与分布 式; 传统 以太 网使用TCP/IP构建网络 ,后续逐渐 发展为 匹配RDM A(远 程直接 内存访 问,能直接 通过网 络接口 访问内 存数据,无需操作系统内核的介入(相比于传统TCP/IP))的RoCEv2(RoCE:RDM A ov er Converged Ethernet)。而InfiniBand专为RDMA设计,初衷是解 决高性 能计算 场景中 集群数据传输瓶颈痛点问题,并直接定向 大规模 并行计 算机集 群

具体而言:

1)性能:InfiniBand在AI训练等GP U高密度集群、算卡互联的场景具备性能优势,而以太网亦加速演进、势头迅猛。InfiniBand在 诞生 后较长 时间内 时延、 带宽、 稳定性好于以太 网,AI需求 的爆发(尤 其Nvidia及其M ellanox生 态优势 )使 得InfiniBand网络成为 重要 的AI集群组 网选择。但同时,2023年 包含AMD、博 通、Arista的超以太网联盟 (Ultra Ethernet Consortium)成立 ,致力 于基于 以太网 生态提升AI/HPC网络性能。24年3月,博通(基于M eta论文 )及Arista分别在AI基础设施 发布会及业绩会 上指出 ,以 太网架 构下的 算力集 群可实 现相比InfiniBand达10%的 性能优 势,InfiniBand与以太网的性能 差异在 逐渐缩 小

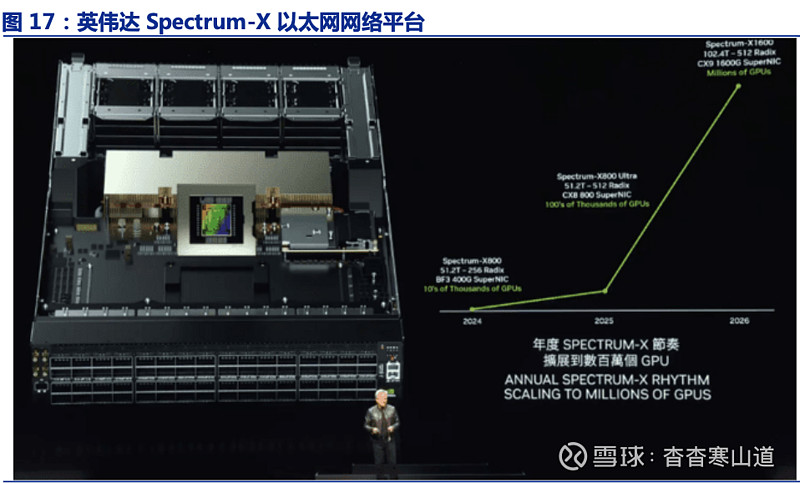

2)兼容性/成本:InfiniBand的生态链本质是性能与成本取舍。搭建InfiniBand网络架构需要使 用专用 的IB网卡 与IB交换 机,本质 是用领 先的性 能与封 闭的系 统换取 用户粘性,对 用户 而言 代价 在于 高溢 价以 及未 来方案 迭代 或转 换的 隐性 成本;以 太网 相对具备较好的 兼容性,组网成 本亦 低于InfiniBand。然 而,一方 面若以 太网性 能有效 提升,在用户综 合兼容 性及成 本的因素下,市 场将重 新考 量InfiniBand的性 价比;另一 方面,英伟达并 非拒绝 以太网 ,其在6月3日COMPU TEX 2024上 强调专 为AI打造 的以太网网络平台S pectrum-X( 此前InfiniBand网络是 重心),英伟 达在网 络领域“两条腿走路 ”的战 略布局 ,表明以 太网 在AI时代具 有持续 生命力 ,亦 会重新 定义以 太网产业格局;

3)趋势:AI产业长期发展由训练为主转向训推并重,以太网高适配性及经济性优势或将凸显。

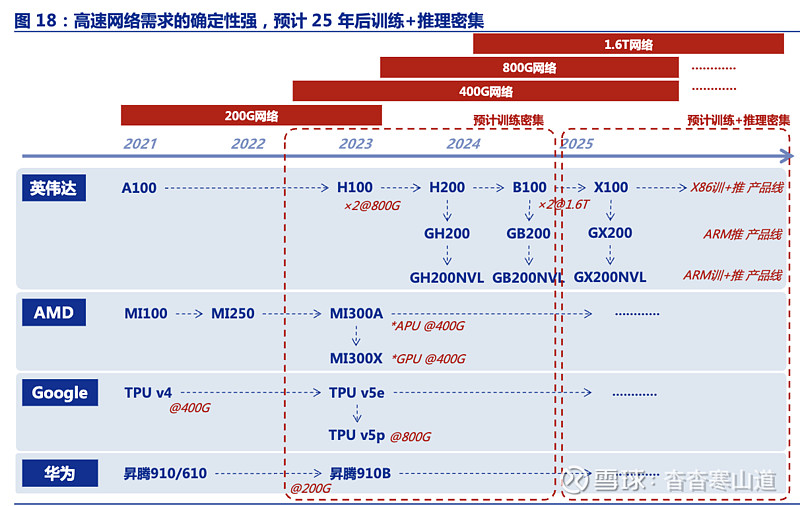

此前我们 预计2023-2024以密集训练为 主、2025年后推 理的比 例将进 一步提升,同 时“ 训推 一体 ”也 将是 重要 场景 ,网络 架构 将发 生深 刻变 化。 整体 而言 ,在持续高速 网络 需求 的大 趋势 下, 推理 侧对 网络性 能( 尤其 并行 网络 )的 要求 ,相 较于训练侧边 际减弱;而应 用层 面,token成本长 期降 低的预 期下 ,网络 的高适 配性 、成本经济性以 及针对 性优化,是 纸面性 能之 外的重 要因素。字 节、M eta等对 以太网 方案的接纳以及英伟达的战略转向即是证明 。

以太网速率演进提速是价值量跃升的重要逻辑。

我们预 计,长 期AI推理 导向的 网络架构,将与 训练网 络有较 大不同 ,将参 考云计 算的虚 拟化和 分布 式设计 (例如 英伟达AI Cloud)。 且当前大模型 参数量 的增速 显著大 于GPU内存 增速, 高集成 度+大内存+多GPU的 系统更 适配大 模型训 推;尤 其多模 态推理 、并发 用户数 爆发等 场景下 ,高端芯片的算 力性价 比更高,大模型 推理亦 需要高 速/高性能卡和大 集群,从 而带动 高速网络持续迭代

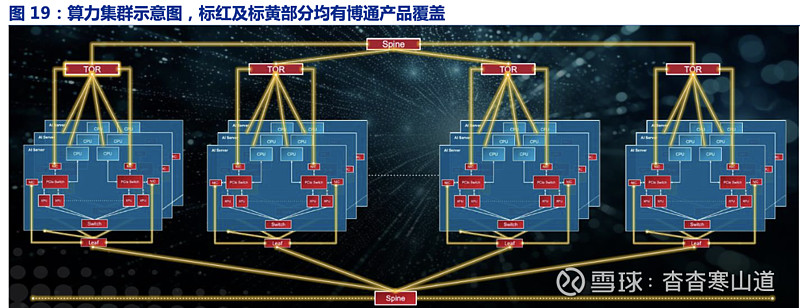

博通可近似看做AI算力网络基础设施的“一站式购物中心”,网络各环节覆盖形成产业链强话语权。在 完整的 算力集 群中 ,博 通可以 提供 除CPU外 绝大多 数的核 心基础 设施产 品,包括XPU、交 换芯 片、PHY芯片、 网卡、PCIe交换 机、DSP、光学 器件、 再定 时器等 等。据 公司FY24Q1业绩会指 引,受 益于AI算 力网络 需求持 续强劲 ,预 计2024财年网 络收入 将同比 增长35%以上

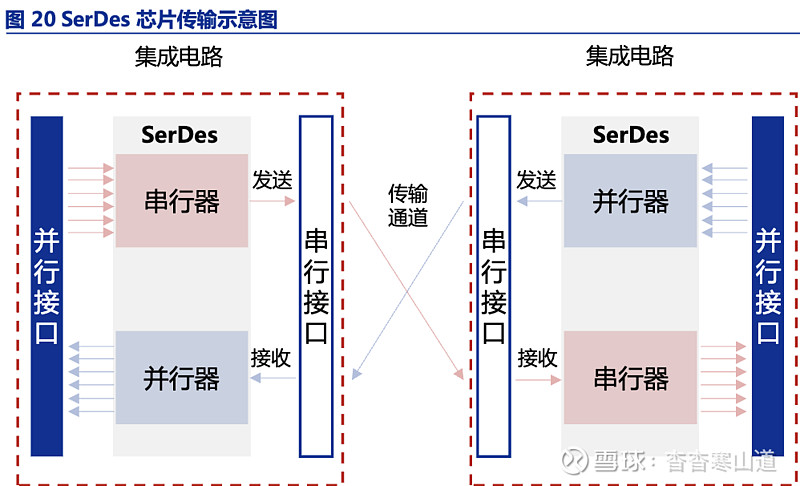

护城河:内生研发能力推进产品线拓展/迭代,SerDesIP保驾护航。公司已 有超6年未收购半导 体板块 相关 公司, 基本 通过研 发能力 提升 内生推 动产 品线迭 代与 拓展。 通过 制程进 步、SerDes速率 提升、通 道数提 升等方 式,博通 交换芯 片带宽基本实 现每两 年翻倍。其中,SerDes(串行器/解 串器)是博通在网络 业务长 期保持 竞争 力并有 能力匹配AI算力 需求的 核心能 力之一。SerDes接口可在传 输之前 将低速 并行数 据转换 为高速 串行数 据,并在接 收端转 换回并 行数据,实现XPU之间信号的高效传输,有 效解 决AI训练 的大规 模并行 计算需 求。

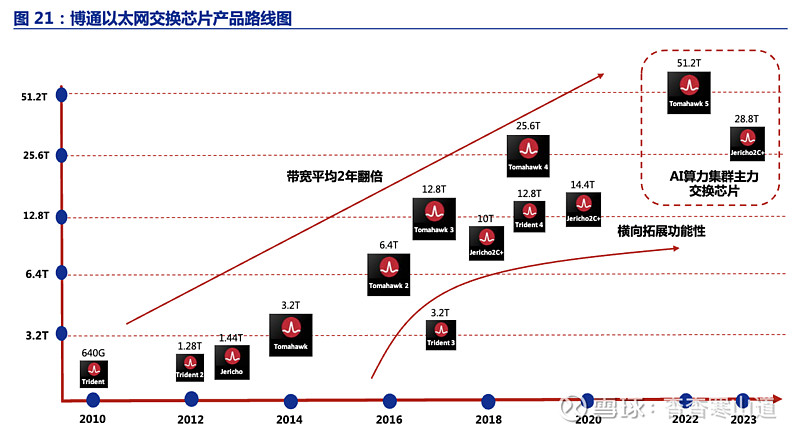

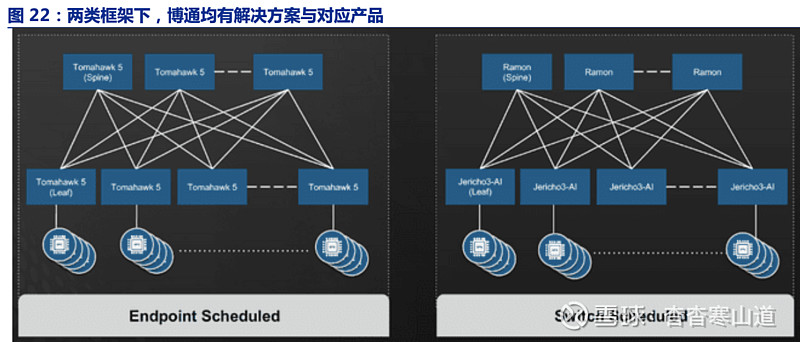

交换芯片:传统网络业务的“压舱石”。博 通 长 期发 展 出两套以 太 网 交换机 解 决方 案:StrataXGS以及StrataDNX。StrataXGS方案侧 重 于 实 现 不 同 产 品 侧 高 带 宽传输, 其 中Tomahawk系列交换芯 片具备 最高带 宽,最 新的Tomahawk 5带 宽可 达51.2Tb/s,该系 列主要用于超 大规模 数据中 心;Trident系列交换芯 片性能 较为均 衡,主要 用于企 业以及 边缘计 算。StrataDNX方案及 旗下的Jericho系列交 换芯片 优势 在于高 拓展性 及高缓 存,易于Scale-out以及解决 网络 拥塞问 题,主 要用于 服务提 供商 。此外 ,博通 为客户 提供统一API, 方便用 户统一调配不同产品线交换芯片;

Tomahawk 5 & Jericho3-AI分别匹配算力集群下终端调度&交换机调度框架,以解决网络拥塞。AI趋 势下的 算力要 求更多 流量并 行,导致 拥塞问 题突出。 主流的 通过终 端调度或交换机调 度解决 网络 拥塞下,博 通均有 解决方 案与 对应产 品。终端调 度及 交换机 调度 的核心 区别在于,前 者使用NIC进 行全部 流量调 度,博 通的Tomahawk系列在 该架构 下充分 发挥高 带宽优势;后者要 求交换 机有效 管理网 络拥塞 问题 ,而 博通23年发布 的Jericho3-AI具 备分层 流量管理功能 ,技术 上通过 智能调 度和预 分配输 出队列 资源实现负 载平衡 和拥塞 控制。据M eta实际测试,使用Jericho3-AI的 算力集 群比运 行相同AI训练 负载的InfiniBand集群 性能高约10%,而成本仅为InfiniBand方 案的一 半;

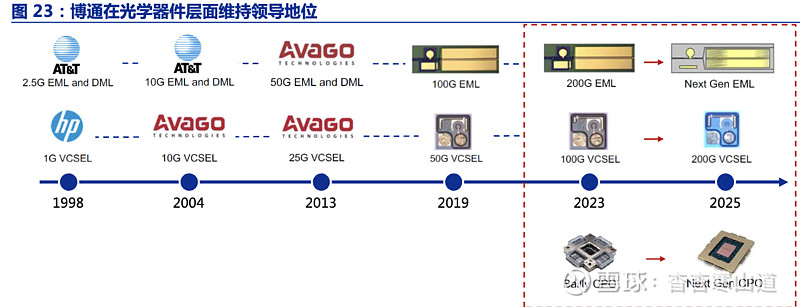

光学器件:VCSEL+EML行业领先,匹配算力扩张。VCSEL(垂直 腔面发 射激 光器)和EML(电吸收 调制激 光器)技 术在光 模块中 为算力 集群高 速互连 发挥至 关重要 作用 。博通是VCSEL与EML市场领导 者,提 供大容 量100G VCSEL 产品,截止2024年3月用于AI/ML系 统的100G高速光器件出货 量已超过2000万。同时, 公司在24年3月宣布200G EML已量产发货,200G VCSEL首次展出,两者将为1.6T光模块 提供强 力支撑;

CPO:带宽瓶颈下未来硅基封装路径,博通储备深厚。CPO(Co-Packaged Optics,光电共封 装)核 心在 于舍弃 模块 形态, 缩短光 器件 和芯片 的电 学互联 长度 以减少 链路 损耗并 提升集成度,有 效突破 电路损 耗瓶颈并实 现更低 功耗,是 未来光 通信可 能发展 趋势之 一。博通在CPO方面有深 厚技术 储备 ,近期已向客 户交付 业界首 款51.2-TbpsCPO以 太网交 换机。该产品集成了八个基 于硅光 的6.4Tbps光 学引擎 与Tomahawk5交换芯 片。与 可插拔 收发器 解决方 案相比,该产品可降低70%的光互连功耗;

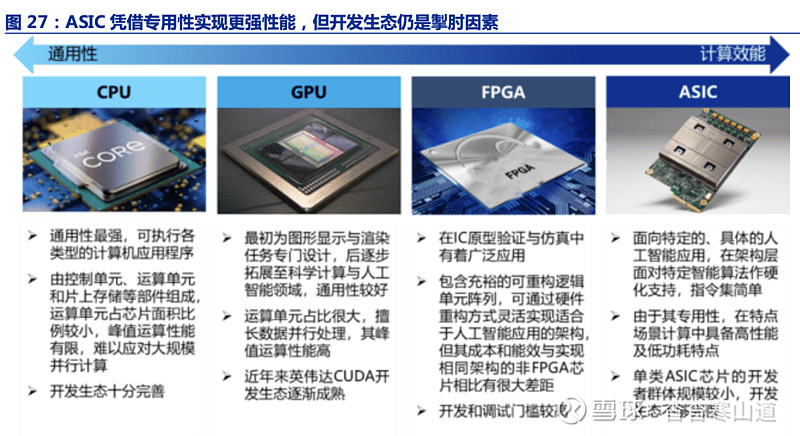

软硬件之间存在较难弥合的语意鸿沟,堆栈协同需要长时间积累。在高 性能计 算中 ,硬件中有丰 富的方 法来 表达复 杂的 计算, 但更多 表现 为底层 编程 代码, 不易 于开发 者掌 握和应 用,因此开发 者需要 依靠智 能的编 译器 、库和 解释器 来无缝 地将高 级代码 转换为 机器表 示,而硬件/软件堆栈 之间的 有效交 互重要 性凸显 ,优质软 件生态 将推动 硬件发 挥接近 理论性 能的计 算能力 ,反正将成为限制因素,而开发生态需 要长时 间的积 累。

架构适配高性能计算推动GP U成为通用计算芯片主流,多年积累的CUDA开发生态为核心壁垒。

相对CPU,GPU计 算单元 比例高 、强 调并 行计算 的架构 更适用 于高性 能计算 ,英 伟达迭代GPU过 程中增 加了CUDA核 心数量 并添 加TensorCore以增强 矩阵运 算能力 加速深 度学习,推 动GPU从图形 处理向 通用计 算(GPGPU)发展 。GPU推 广之初 ,相 对当时 已经拥 有成熟的开发 生态CPU,长 于多核 并行计 算的GPU的软件 堆栈无 异于对 编程语 言及资 源库等 的一次重构,而 英伟达 通过 对CUDA生态 十余年 的积累, 已经在 编程语 言和API、开 发库、分 析和调试工具 、数据 中心和 集群管 理工具 方面形 成丰富 而成熟 的开 发环境 ,构成 了AI计算 的基石

XPU芯片具备高效能低功耗特性,强调场景专用性。XPU为专 为AI计算 设计的 一类ASIC芯片, 其从设 计之 初即强 调专 用性, 基于特 定应 用场景 、算 法框架 进行 针对性 优化 ,可大 幅降低计算成 本、提 升计算 效能, 这是设 计理念 和基础 架构上 相对GPU的优 势。XPU的设计 需要厂商对应 用场景 有深刻 和精确 的了解 ,这是 传统芯 片设计 企业和IDM的 短板, 因而XPU的开发通常以谷歌、亚马逊等科技巨头为 主导, 芯片企 业提供 辅助 配套服 务。

短期看开发生态掣肘XPU大范围推广,科技巨头第一目标为满足自用。

XPU的缺点 来自:1)场景和算 法需 要固定, 且重 新设计 会有较 高成本 ;2)开发 生态不 完善, 缺乏开 发者群 体构建软硬件 堆栈协 同。而开 发生态 为掣肘 科技 巨头推 广XPU的 核心因 素,需要 相对成 熟的算 法框架、开发 资源库 提供硬 件开发 支持,谷歌TPU基于TensorFlow算法 框架,可支持 搜索等 业务的算力需 求以及G emini大 模型的 训练推 理需求 ,但获 取外部 客户方 面仍有 较大难 度。从 短期看,科技巨头对自研XPU的目标 仍为满 足自 身算力 需求, 以降低 日趋高 企的算 力成本 。

)对科技巨头而言,降低自有业务算力成本+算力供应链可控需求强烈。谷歌 、微软 、亚马逊和Meta已成 为高性 能计算 芯片的 主要客 户,根据O mdia,2023年四大科技 巨头仅 英伟达H100就购 买了 约40万块 。而 高性能 计算芯 片的需 求将从 百亿美 元级(2022年 英伟达 数据中心业务 产品营 收为150亿美元), 向千亿 美元级 跃升(AMD预计到2027年AI芯片+相关配套芯片 市场规 模为4000亿 美元),市场规 模量级 的提升 将推动 科技巨 头加快 自研XPU芯片的研发与部署。

2)对于非云厂的AI企业而言,AI应用及大模型优胜企业将主动对算力成本进行优化。当前AI初创公 司仍处 于百花 齐放阶 段,呈 现各初 创公司 算力需 求不足 够大而 需求急 迫的特 征,难以考虑算 力成本 优化的 问题 。但随 着未来 爆款AI应 用的出 现以及AI大 模型格 局逐渐 走向清 晰,成熟的AI优 胜企业 将具备 算力需 求庞大 且长期 需求 稳定的 特点, 有望向XPU芯片 主动靠 拢,Anthropic、Character.AI等已 部署 于AWS和GCP的XPU芯片之 上

科技巨头XPU持续放量,Marvell预计2028年XPU加速器市场规模将达到429亿美元。24年XPU将陆 续放量 ,Marv ell预估AI加速 器芯片 在算力 芯片( 不包含 存储等) 的占比 将从16%提升至25%,5年CAGR有望达到45%,2023至2028年市场空间将从66亿美元 扩张至接近429亿美元;

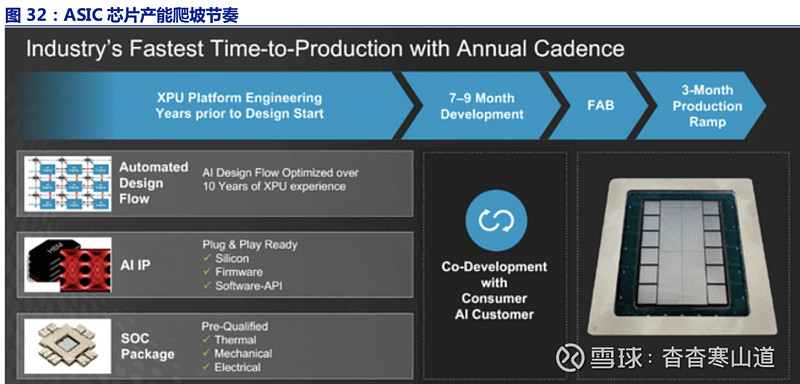

依托丰富的IP核以及多年XPU设计经验,博通深入参与XPU研发的众多配套环节。博通拥有在 计算、 存储、 网络等 领域众 多IP核,可 支持IC设计 的众多 环节, 当前已 构建了 相对完整的ASIC芯片 开发平 台,可以向 客户直 接提供 全套 辅助服 务:1)运 算单元 :核 心运算 单元架构主要 由客户 根据自 身场景 需求和 算法进 行设计 ,博通 提供设 计流程 和性 能优化 等IC设 计的配套服务 ;2)存储 及网络 :可提 供HBM接口 、AI算 力网络 接口以 及系统 解决方 案;3)封 装:提供2.5D、3D封装等 服务,具备垂 直集成 方面的 优势。也 即,自 研XPU客 户仅需 针对最 核心的运算单元架构进行设计,将其余环 节向博 通研发 外包;

博通与谷歌TPU深度合作多年,市场猜测未披露的两大XPU客户为Meta和字节跳动。公司披露 ,截 至24年3月公 司已拥 有3家XPU客 户。公司与 谷歌 在XPU领域 的合作 超过10年,已迭 代了10个TPU版 本,为 公司最 大XPU客户。 与第二 大客户 (预计 为M eta) 合作4年迭代 了4个 版本 的XPU,24年已 进入XPU量产 阶段。此外,24年3月公司 披露了 新的XPU客户(市场猜测为字节跳动),当前 已完成 芯片开 发,开 始投 入生产 。

XPU业务预计将在24年贡献70亿美元收入。公 司预计2024财年AI业务收入 将达到100亿美元, 其中AI加速 器的占 比约 为70%,网络及 光学等 其他组 件占比 将为30%,也 即24财年单XPU业 务将为 博通带 来近70亿美元 的营收,相 对23财年 增幅明 显(预 计约28亿美元 )。

博通XPU业务收入同XPU产量相关性高,近看谷歌TPU放量,后看另两家XPU客户的产量爬坡。谷歌的 多模态 大模 型Gemini训练推 理及搜 索等业 务均基 于TPU部署,24年4月,谷歌DeepMindCEO Demis Hassabis表示“谷 歌正计 划投 入1000亿美元 用于人 工智能 技术的研发”,谷歌 对AI算力 的旺盛 需求使 得TPU在24年 的放量 具备确 定性。此 外,博通披 露除谷歌外的 其余两 位XPU已 完成设 计进 入产能 爬坡阶 段,由于XPU芯 片在量 产应用 之初需 培养开发环境 ,逐渐 适配各 应用场 景,预 计这部 分XPU需求将 在未 来1-2年内陆 续释放 ,为博 通带来中期的业绩新增量;

博通XPU护城河:雄厚的XPU技术实力,丰富的IP核及技术专利,以及算网协同。

23年9月,科 技媒 体TheInformation报道“谷 歌正计 划在最 快在2027年 放弃与 博通的合作, 以节省 每年 数十亿 美元 的支出 ”,但 后续 谷歌官 方表 示否认 ,并 强调谷 歌需 要博通 作为合作伙伴。

我们认为,博通与谷歌的合作关系存在较强的韧性,替换存在较大难度。1)IP核与技术专利具备强粘性且难以复制:博通与 谷歌TPU芯片的 合作中 ,尽管 核心架 构均由 谷歌完 成设计 ,但博通 提供的 封装 、内存 、连 通性和 光学等 专有 技术同 样具 备较高 的技 术难度 ,替 换供应 商或自研替代 均需要 付出时 间和资 金成本 。2)长期积累的雄厚技术实力:在XPU开发 难度持 续提升的大背 景下, 博通将 有力地 帮助谷 歌TPU持续 进步迭 代,从 谷歌的 角度 来看, 保持在AI算力层面的 领先优 势,为大 模型、 云业务、AI应 用提供 坚实的 支撑为 核心诉 求,替换 一个可 靠的芯片合作伙伴将会在TPU的开 发迭代 上受到 影响。

中长期需要关注谷歌引入新合作者,通过压价降低博通XPU业务的利润率。谷歌寻 求引入第二XPU合 作者未 获得实 质性进 展,一 方面凸 显博通 的护城 河,另一 方面确 实体现 谷歌希 望改变博通在XPU业务上 获得长 期高收 益的强 势地位 。但整 体看,XPU放量带 来的收 入增长 仍为主旋律,利润率的影响预计有限。

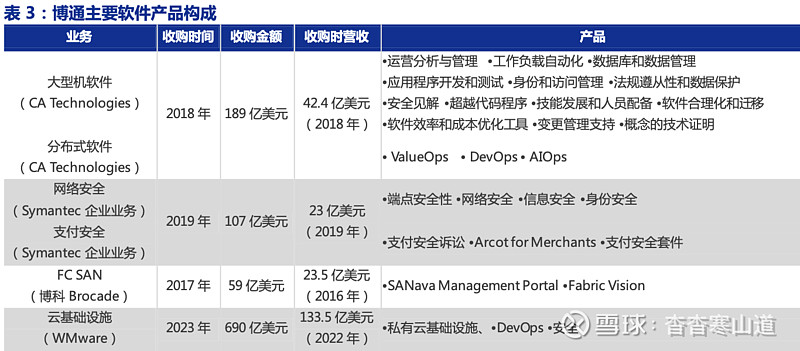

硬件布局趋于完整,博通向软件延续收购节奏以求软硬协同。随着 硬件 布局的 完善 ,博通在2017年后 逐渐停 止并购 硬件厂 商转向 并购软 件企业 ,标的 选择来 看,细 分领域 的领军 企业为主要目 标, 尤其属 意核心 业务的 高壁 垒、粘 性强的 公司, 并寻 求业务 协同。1)大型机软件/分布式软件:来 源于收 购CA Technologies,据Gartner 数据,2020年全 球大型 机软件 市场中,博通 市场份 额约为37%。2)FC SAN:来源 于收购 博通,基于 光纤通 道技术 的存储 区域网络解 决方案,使 用光纤 通道 协议来 连接存 储设 备和服 务器 ,提供 高性 能、可 靠性 和扩展 性的存储解决 方案。3)网络安全/支付安全:来源于 收购Symantec的企 业安全 业务。4)云基础设施:来源于收购VMWare,VM Ware为 云虚拟 化软件 领军企 业;

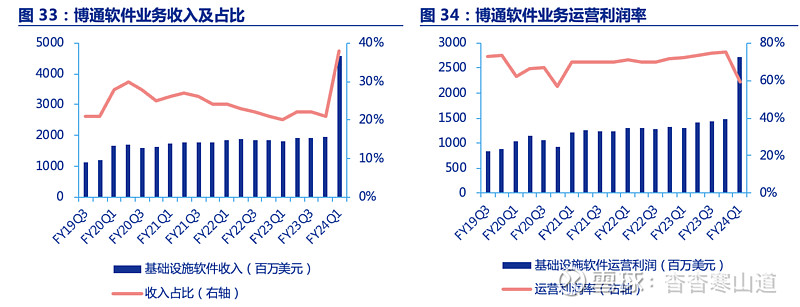

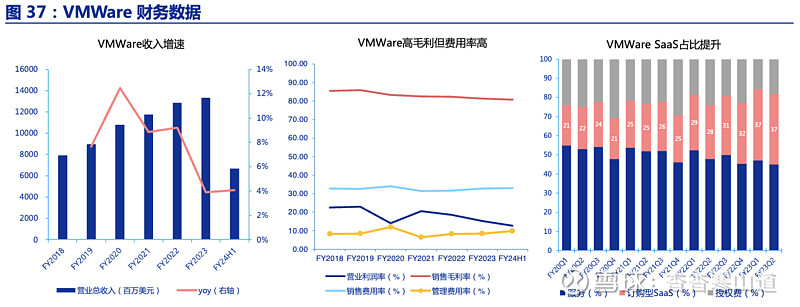

长期看基础设施软件业务利润率表现优异,VMWare并表暂时形成拖累。2023财年博通基础设施 软件收 入76.37亿美元,收入占比21%,运营利 润率75%,保持 较高盈 利水平。收购VMWare后,FY24Q1基础设施 软件业务收入46亿美 元,同 比增 长156%,其中VM Ware贡献21亿美 元,软 件业务 收入占 比提 升至38%,但 拖累运 营利润 率降 至59%,后续需 关注VMWare并购整合后的利润率回 升。

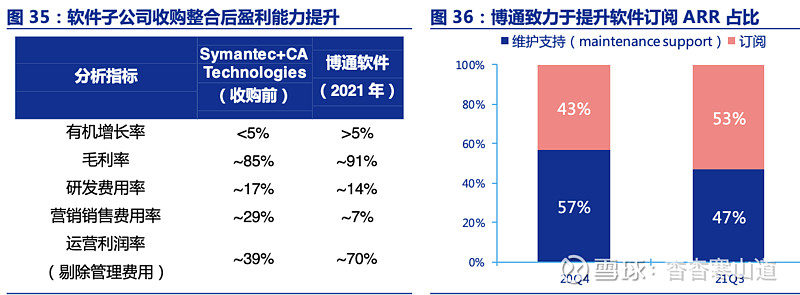

销售体系复用+剥离非核心业务为博通收购整合法则,VMWare有望复制。从过往 收购来看, 公司 收购 整 合提 升盈 利能 力 的方 式包 括:

1)出售非核心业务,提高运营效率。收购CA Technologies后聚 焦盈 利能力 强的 大型 机业 务,出售Veracode SaaS, 博通2019 年收购Symantec后 即向SaaS 行业 多家参 与者 出售较 小部 件。

2)销售体系复用降低费用率:博通多项收购 中客户 群体 重叠, 为销售 体系复 用的基 础,有 利于降低销 售费用 率改善 盈利水 平。

3)从永久许可转为订阅制。博通 在完 成收购 后致 力于推 动将 出售 许可证向S aaS转化 ,FY20Q4有43%的软件 业务ARR来自 订阅, 在FY21Q3提 升至53%,向SaaS转化 可提升 盈利的 稳定性,并降低维护支持方面的成本;

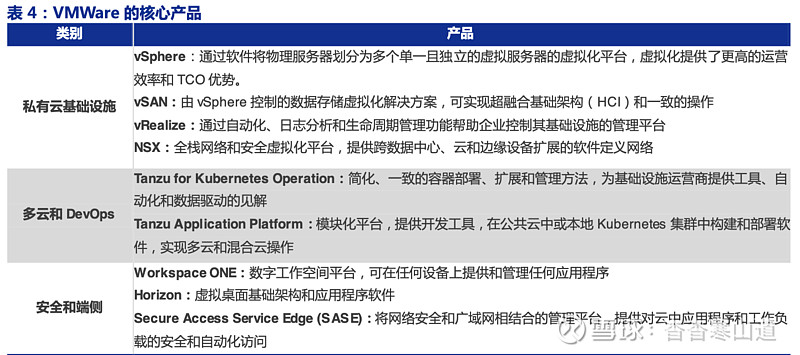

VMWare完成了全IT架构的虚拟化技术布局。1998年VMWare成立 并推出X86系统虚拟化解 决方案Workstation,奠 定虚拟 化行业 领军地 位,后 续推出 新产品 和积极 并购迅 速丰富产品矩 阵,2009年推出V DI桌面 虚拟化 方案VDI以及虚 拟化平 台vSphere,2012年收购Nicira进入软件定义网络领域,2013年发 布存 储虚拟 化产 品vSAN和网 络虚 拟化产 品NSX。

VMWare在云虚拟化领域保持统治地位。据中 国 国 家市 场 监 管 总 局 披 露 ,2021年VMWare在 全球 和中 国境 内非 公有 云虚 拟化 软件 市场 的份 额分 别为92%-97%和22%-27%(均排名 第一)。2016年以 来VMWare将混 合云定 位为长 期战略 方向。2016年 以来VM Ware先后与AWS、Azure、GCP、阿 里云等 公有云 巨头合 作

VMWare历史财务数据体现了高市占率标准化纯软件产品的优势,高毛利率、SaaS化,但是费用率较高,被博通收购后运营效率提升可期。上市以来VMWare的毛利率为80.81%-85.98%之间。但 是 管理 和 销售 等 费用 率 较高 ,侵 蚀 了运 营 利润 。VM WareFY2023营业收入 为133.5亿 美元,FY24H1 VM Ware管 理费用 率为9.9%, 销售费 用 率33.0%,运营利润率为12.8%。

博通收购VMWare后复制了此前的软件类标的整合方法。1)简化产品:从原来 的160多种产品 简化 为2种 主要平 台vSphere Foundation 和VM WareC loud Foundation, 其他功能如vSAN、分 布式 防火 墙、 负载 均衡 、灾 备等 功能 变为 附加 功能。2)商业模式上取消永久许可,转向订阅制:实际 上VMWare在收 购之前 就已开 启SaaS化,FY20Q1公司首次 在财报中披露 了SaaS收入 占比20.9%,FY23Q2SaaS业 务的收 入占比 达到36.9%;博 通在完 成收购后加速 这一进 程,于23年12月停 止永久 许可证 的销售 、永久 产品的 支持 和订阅等,全 面转向SaaS。3)加强创新及优化销售服务:计划每 年增加 投资20亿美 元一半 专注于 研发, 另一半专注于 通过VM Ware和合作 伙伴专 业服务 帮助加 快VM Ware解 决方案 的部 署。在市场 进入和支持服 务方面 :VM Ware有30万客 户,对于2000个 战略客 户,销售推 广VCF平台和 私有云服务,对于中小企业客户则重点销 售改进 版的虚 拟化产 品。

据博通FY24Q 1业绩会指引,VMWare的收入在本财年后续季度环比增长将超两位数,2024财年软件业务实现约200亿美元收入

博通收购VMWare、布局软件业务的战略意图:1)看 好混合 云的长 期前景 以及布 局高毛利业务的 野心 ,VMWare是 虚拟化 、私 有云起 家的行 业领 军者。2)VMWare、Symantec、CA Technologies拥有广大的 企业客 户基础, 通过多 业务 整合、交 叉销售, 加强软 件业务 的实力。博通软件集 团将在 收购完 成后将以VM Ware的名 义运营 ,将博 通现有 的基础 架构和 安全软件解决 方案加 入VMWare多云 产品组 合中, 合并后的博通 软件力 图为企 业客户 提供多元化的关键 基础 架构 解决 方案 。3) 软硬 一体 化, 提升 硬件 吸引 力及 软件产 品的 竞争 力。VM Ware面临公 有云巨 头的 竞争, 在博 通的资 金投入 和市 场拓展 帮助 下,有 望迭 代产品 能力 和市场 触达能力。 另一方 面对 于半导 体解 决方案 起家的 博通 ,提升 软件 实力, 有助 于构建部署 在私有 云的高性能软件定义数据中心。

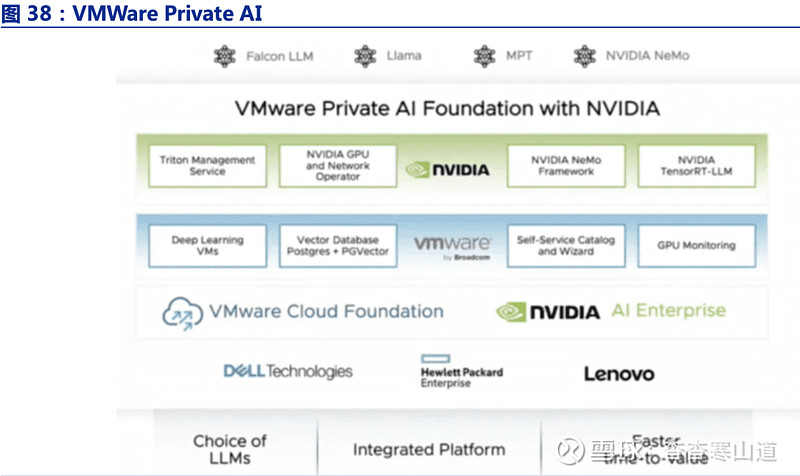

2023年以来VMWare积极布局生成式AI,推出Private AI。Private AI可支持 多云环境中 创 建 训练 、 测 试和 部 署 企业 级生 成式AI模型,并且 能 够 符合 隐 私及 安 全 管理 的 要 求。VMWare发 布了两 个AI解决 方案 :1)VMWarePriv ate AI Foundation with NVIDI A,是一款全面集 成的解 决方案 ,结合 了NVIDIA的生 成式AI软 件和算 力加 速功能 ,构建在VM WareCloud Foundation之上, 并特别 针对AI进行 了优化;2)VMWarePrivate AI Reference Architecture for Open Source:通过 支持开 源软 件(OSS)技术 ,帮助 客户 实现所 需的AI成果;