——————————————————

车载语音「崛起前夜」

一

2021年CES前夕,宝马为了帮助其第8代iDrive系统预热,放出了一段颇有意思的视频。

在这段视频中,宝马于2001年推出的搭载第一代iDrive的7系和即将推出的搭载第8代iDrive的iX,展开了一场吐槽大战。iX尽情地展示其全新的智能科技,老7系则认为iX只是个玩具。

2020年,车载语音开始出现一些现象级的产品。10月24日,小鹏发布了「全场景语音交互系统」,之前,斑马这样的系统级供应商也推出了类似的产品。这些产品不再满足仅仅推出一项项单独的功能,而是将车载语音当成车内的核心交互方式去打造。

「小鹏汽车认为未来车内交互的核心方式是语音而不是触控,这是我们对未来的判断,所以我们会投入更多的自研资源去做这些事情。」小鹏汽车语音负责人赵恒艺如是说。

这些产品展示了车载语音定义车内下一代交互方式的巨大潜力,不仅在产品体验上,更是从产业层面,积极推动传统车载语音行业的变革。智能电动车的崛起,使得车内的交互方式正在发生猛烈的变化。

在传统燃油车时代,旋钮、按钮等物理按键是车上的主要交互方式之一,功能的实现主要依靠分布式ECU,一个ECU对应着一个或几个按钮,每当要增加新功能时,大多需要加一个ECU,有些功能还需要再配一个相应的控制按钮。

在这种情况下,语音作为交互方式的价值开始显现。按钮不可能无限增加,但是指令可以有无限多条。另外,随着车内信息娱乐系统的发展,越来越多的娱乐、内容被搬上车。

信息越来越多的同时,屏幕也变得越来越大。1月份,奔驰发布了为EQS准备的56英寸超大屏幕,智己汽车发布的新车也已经将屏幕尺寸提升至39英寸。

这些屏幕在输出信息和内容时是高效的,但做信息输入却是低效的。试想一下,被固定在座位上的司机在开车时,如果想要通过手指去操控这些屏幕,几乎是不可能的。另外,大屏触摸,在行车过程中的交互还会威胁到行车安全。

车辆功能和车上内容的丰富,以及对安全的需要,语音交互都能很好满足。

语音交互有其特有的优势。在开车时,人的眼睛和手脚被限制在驾驶行为中,这是语音的天然优势。另外,语音交互在理论上可以一步直达任何功能,而中控大屏的各个层级以及菜单则令人颇为费神。

但目前的现实是,在座舱领域,屏幕是比语音更主流的交互方式,即使是以特斯拉为首的各大智能汽车厂商,虽然既有GUI(图形用户界面)交互,也有VUI(语音用户界面)交互,但主要的交互仍以中控大屏为主,语音交互仅作为辅助,体验不佳,备受用户吐槽,存在感寥寥。

这并不是语音交互这项技术的问题,其背后有更深刻的行业因素。

二

在市占率上,科大讯飞、Cerence(Nuance子公司,已于2019年独立)稳占前两名,科大讯飞在中国车载语音市场的占有率超过40%,语音方案主要装配在自主品牌车型中。Cerence的市占率超过30%,主要以合资车型为主。

Cerence目前搭载在全球3.25亿辆车上,2019年全球量产车辆中的一半搭载了Cerence,是「诺基亚」一样的巨无霸存在。

2020年,科大讯飞在车载领域出货量超过600万台,累计装车量超过2900万台。

讯飞、Cerence等技术厂商当前的主要策略是,用更小的成本,服务更多的厂商。他们多数的合作以标准品为主,在灵活性和定制性上稍差。这种统一的方案,以传统的收取License的模式为主,一次性收费,价格一般在100元/辆左右。

2019年科大讯飞在汽车领域的营收为3.72亿元,出货量超过500万套,每套的价格约合74.4元。

2018年,Nuance的车载业务营收2.79亿美元,每套价格低至6美元。

传统的语音技术供应商,不论是国外的Nuance,还是国内的科大讯飞,其主要业务主要在to B、to G等领域,他们在医疗和教育领域分别有着大量的积累,占据着很高的市场份额。

车载语音在这些厂商的业务中只占很少一部分,尽管他们在车载领域已经耕耘了很多年,但主要的合作方式是,将自己在语音技术上整个链条的能力打包输出给主机厂,并且以通用方案为主,这种模式不论是在打造产品体验上还是在营收规模上,天花板都比较明显。

在这种情况下,即使传统技术厂商拥有大量的装机,但却面临一些桎梏,无法跳出循环:

1. 用户不爱用,导致很难收集数据。当然了,这是产品、技术、场景综合叠加的问题;

2. 全双工、连续对话、免唤醒等一些技术没有大规模普及,车载场景下的数据收集不丰富、不全面;

3. 和主机厂的合作程度不深,无法拿到更多的用户数据和车辆数据,对于车载场景很难有进一步的理解。

无法有效收集数据和深入场景,就无法打造优秀的体验。

2020年10月24日,小鹏P7推出全场景语音系统,一经推出便引发行业广泛关注和一致好评。

在小鹏发布的全场景语音系统中,可以实现精确的车控操作,例如可以通过语音指令将车窗打开18%、20%,精度可以达到1%;可以对音乐播放进度进行秒级的调节。

在推动车内语音交互的体验变革方面,小鹏汽车赵恒艺表示,应该从以下几个层面去看待这个问题。

首先,它需要自上而下去定义这个汽车,包括按键、屏幕、操作系统和应用、车内的各种ECU,且都是开放可定制的能力;

第二,语音交互框架是否具备足够的鲁棒性,真正做到好用,而不是只是演示效果;

第三,组织上是否达到一致的认同,能够形成一致的目标去完成非常多细致的功能,这是需要很大的工作量,也需要非常大的组织资源。

小鹏从主机厂的角度给了三层视角,从整个行业层面,行业人士们纷纷对小鹏和思必驰的深入合作表示赞赏:双方分工明确,协作紧密,小鹏长于产品定义和用户体验,思必驰长于在车载语音全技术链条的能力,当然了,语音合成方面的能力还有待提高。

不仅小鹏和思必驰在深度合作,大众和出门问问还成立了合资公司大众问问。

出门问问副总裁、车载技术负责人叶顺平介绍,

在三方的合作中,大众负责把握产品方向,输出产品定义;大众问问负责跟车载相关的产品以及交互细节,做需求的理解和拆分等;出门问问负责通用AI,如语音识别、唤醒、自定义唤醒词、快捷命令词、语音播报、自然语言理解、对话引擎、声纹、声音克隆等。

由主机厂提出更深入、更细致的需求,技术供应商负责实现,双方搭配进行更深入的合作正在成为趋势。

三

要打造可升级的语音交互系统,需要同时在技术和产品上下功夫。

在技术层面,一些新的语音语义技术能力在不断被引入车内。

小鹏之前发布的全场景语音系统,一些基础的能力底座包括:「连续对话能力」、「语义拒识」、「语义打断」、「双音区语音识别」。

产品和应用在这些能力底座上开花结果,但要往更底层看,这些技术能力,是基于语音交互完整且清晰的技术链路。

在技术链路上,语音交互技术大概包括声学前端,语音识别(Automatic Speech Recognition,ASR),自然语言处理(Natural Language Processing,NLP),对话管理(Dialog Management,DM),语音合成(Text-To-Speech,TTS)等。

声学前端,即从噪声背景中提取有用的语音信号,在车端一个比较大的问题是针对车内的声场做麦克风的降噪。

出门问问叶顺平表示,智能耳机一般控制风噪等即可,并且信噪比相对比较高,而车载语音面临的噪声环境较为复杂,有空调、胎噪、发动机、电动机的声音,以及开窗时的风噪、外界噪音等,而鸣笛等一些非稳态的噪声,也存在挑战。

语音识别(ASR),即把语音信号转变为相应的文本,斑马语音负责人吴晓敏认为挑战在于,怎么针对前端不太好的降噪场景,去训练一个用于车内专门语音识别的模型,尽管有降噪,但在信号不干净的时候,语音识别能不能兜得住。

他表示,“例如科大讯飞、阿里达摩院,在针对降噪方面,也用深度学习的方式去做,做端到端的降噪。”

另外,语音识别的鲁棒性挑战也比较大,例如方言、普通话不标准等。

可以说,车载语音技术供应商们在降噪和语音识别方面投入了大量精力。

自然语言处理(NLP),广泛应用在搜索引擎、机器翻译、人机对话等各领域,收敛到我们所关注的语音交互系统中,包括自然语言理解(NLU)和自然语言生成(NLG),简言之是要使计算机既能理解自然语言文本的意义,也能从知识库或逻辑形式等机器表述系统去生成自然语言。

比尔·盖茨曾说,“自然语言处理是人工智能皇冠上的明珠,如果我们能够推进自然语言处理,就可以再造一个微软。”

微软研究院等机构认为,语音识别(ASR)、语音合成(TTS)、计算机视觉(CV)等属于感知智能的范畴,而自然语言理解(NLU),属于认知智能的范畴,从感知智能到认知智能对人工智能来说是一步重大的跨越。

历史上,NLP的发展有几个关键节点,其中,最重要的两个当属2012年和2018年。2012年,深度学习开始应用于NLP领域;2018年开始,以谷歌BERT为代表的语义表示预训练取得了巨大突破,横扫各大NLP任务基准。

2020年5月,OpenAI斥巨资打造的GPT-3一经发表就引发行业轰动,这一版本的模型有1750亿参数量,被称为NLP领域最强AI模型。但在实际应用过程中,还是出现了带有歧视性、偏见、低级错误的语句。

具体到应用领域,NLP本身并不成熟,在车载上的挑战还受限于数据。车载场景下,用户的需求主要集中在车控、导航、娱乐(音乐、播客等)等,在一些高频对话的定义上,整体效果会好一点,但在一些低频的对话上,受限于语料、数据量不足,导致不能涵盖尽可能多的用户说法,在体验上不尽如人意。而如小鹏这样的造车新势力企业会做一些车控语义部分的工作,来提升用户体验。

对话管理(DM),在接受到用户的信息之后,DM模块会判断接下来应该执行什么动作以及给用户什么反馈。DM主要分为闲聊式对话与任务式对话。

闲聊式对话:主要的考核指标是,和用户进行的对话轮次。闲聊式对话希望与用户实现尽可能多轮次的交互。早期对话引擎采用检索模型,即从语料库或者公开资料中检索素材来回复用户,后面开始利用深度学习来生成模型,并将两者结合的方式来做对话引擎。2019年微软小冰与用户的单次平均对话轮数突破了23轮,是世界领先水平。

任务式对话:用更少的轮次去达到任务,考核指标是任务完成率,车内目前以任务式对话为主。在车内场景中,例如用户说“地图放大”,对话管理决定后面的流程怎么走,例如要不要去问用户打算把地图放大到什么比例,还是直接把地图放大一倍。

语音合成(TTS),即把文本转换为语音,并进行播报。

出门问问叶顺平表示,TTS对算力要求较高,一般布置在云端的时候,借助于大的算力和模型,可以实现较好的、接近真人的效果,但如果处于离线状态下的播报,受限于本地资源,会让用户感觉比较机械。

语音交互整个链条涉及到声学、自然语言处理、数字信号处理等多个复杂学科,各个环节相扣,组成一个语音交互系统。

NLP在整个链条中比较偏后段,需要依赖很长的前端链条,比如信号处理、语音识别、文字输出之后才会用到NLP,前端链条上的因素对后端流程都会产生影响,例如信号处理会影响语音识别,语音识别如果出错就会影响NLP的判断,链条上每个模块都需要提高可靠性,才能保证最后出来的整体结果可靠。目前大的预训练模型,对提高语义理解有一定帮助,但是整体的技术突破仍然不够大,如何在低成本短周期内,尽可能理解用户千奇百怪的表达习惯,依然充满挑战。

出门问问叶顺平表示,“现在大的趋势是做端到端系统,不再分成四个任务或者五个任务分别训练,而是整个任务一起学习。”

他表示,“以前各环节的模式是,先做好降噪,再给语音识别,当噪声比较大的时候,唤醒词可能会唤不醒。目前的趋势是,in-house自研把降噪、语音识别、语音唤醒几个任务进行联合训练。”

“之前的流水线作业(pipeline),每个模块各自完成自己的环节,各个环节之间割裂,每个步骤都错一点,在每一步上都会引入(假设)5%的损失,而端到端的系统,可能整体是5%的损失。”

另外,车载语音的网络问题也是一个挑战,例如在高速公路上网络不好,或者一些地区的网络不好。解决在离线场景下的鲁棒性也是车载语音交互的一个重要议题。

智能音箱等智能家居产品,长期处于WiFi环境下;智能手机等设备受限于算力和功耗等问题,均把模型和计算布置在云端,终端的计算比较少,例如苹果的Siri在离线状态下就不可用。

但车载场景,需要打造离线在线混合系统,确保离线可使用一些常规功能,例如车控等。

斑马智行语音负责人吴晓敏表示,“车载语音全链路都要对离线场景做支持,做到离线场景下,整个交互还是可用的。”

“像语音识别、自然语言处理,大家现在都是在用深度学习的方式在做,运算量还是很大的,怎么样在离线场景,做出一个基础版本,满足用户的基本需求,这是一个挑战。所有的厂商都有解决方案,只是解决得好与不好的问题。”

四

基于以上的技术链条,有一些关键技术开始进入应用领域,极大地提升了语音交互系统的体验。

全双工、连续对话等技术,开始跑步进入车载市场。

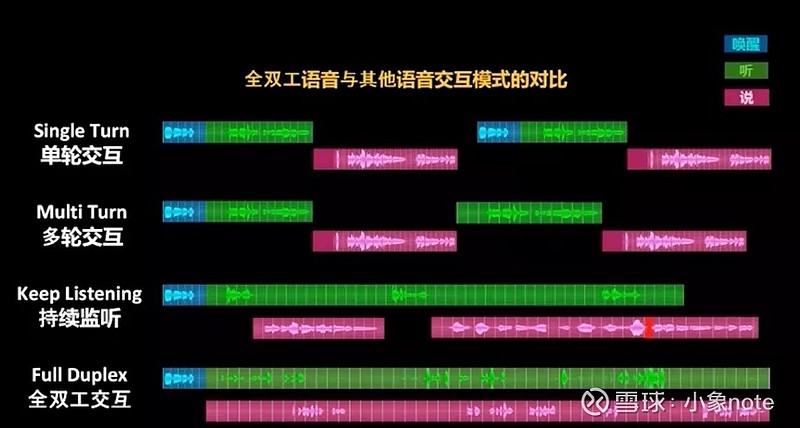

全双工交互(Full Duplex),是一个通信术语,意思是实时双向语音信息交互,例如电话就是全双工的,双方可以同时说话。与之对应的半双工,最典型的是对讲机,一方在说话时,另一方只能听,不能讲话。

微软亚洲研究院认为,在技术模块上,半双工只需要三个模块:语音识别、对话引擎、语音合成。而全双工至少需要6个模块:连续语音识别(Continuous Speech Recognition)、语言预测(Language Prediction)、对话引擎、语音合成、每轮控制器(Turn Coordinator)、节奏控制器(Rhythm Coordinator)。

全双工更接近人和人之间正常的对话,用户既不需要多次唤醒系统,同时在系统进行TTS播报时,用户也可以说话,并被识别以进入到新的任务。

要基于全双工交互技术,打造流畅的「连续对话」能力,有一些重要的挑战:

1. 对语音识别的挑战

在连续对话的场景下,可能用户不再仅仅和语音系统交互,用户可能会去和副驾、和其他人聊天,识别任务就变成了任意的识别任务,语音识别的任务更大,识别系统的领域变宽,更具有挑战性。连续对话需要语音交互系统对任意场景都能很好地识别。

2. 「语义拒识」,当用户唤醒系统后,有些话不是对系统说的,语义理解能力需要过滤这些不是和系统聊天的话,这就是拒识能力。

语义拒识需要用更大的模型去判断,只有积累了大量用户闲聊、打电话等的数据,才能把拒识率做上去。

当你的拒识能力越强,「免唤醒」的持续时间便越长,斑马联合上汽打造的维纳斯语音系统可以达到90秒内免唤醒。

免唤醒可以理解成手机上的触摸屏,如果你每划一次手机,都要解锁一次,是不是很让人崩溃。在智能家居领域,由于用户习惯等问题,一般是不做免唤醒连续对话的,但在车载场景下,用户与语音系统的交互更为紧密频繁,免唤醒连续对话很有必要。

免唤醒的时间越长,在语料收集方面,就拿到更多、更好的数据。有了更多的数据,通过持续的训练,拒识能力也会越来越好,这一点类似于增长飞轮。

随着技术的发展,未来还有可能走向全时交互,即在任何时候都不需要唤醒。

之前的语音系统都是面向单个任务,在引入了全双工、连续对话等技术之后,语音系统开始面向对话全程。在这个过程中,由于用户的行为是随意的,但这对于语音系统来说,跨域(domain)之间的跳转却颇为挑战。目前,一些连续对话主要应用于受限的场景,例如在导航的时候,只能连续进行导航指令的对话,不能跳到音乐或者其他的domain。

对车企来说,了解上述的链路以及技术至关重要。出门问问叶顺平认为,“车企不可能像技术供应商一样去建设大规模的语音识别、语义理解团队,不需要(车企)掌握技术原理,但需要能看到中长期的趋势,因为车的量产周期很长,如果看不到中长期的技术趋势的话,很可能在车出来的时候,你这套语音方案就是落后的。”

「全双工」、「连续对话」、「免唤醒」、「全场景」,甚至「全时交互」,这些都是技术能力,产品能力也同样重要。

曾打造了蔚来NOMI的镁佳科技CEO庄莉认为,技术可以解决「有用」,产品可以解决「有趣」的问题。她认为,做VUI的产品经理要有技术背景,这样才能更好地做产品定义。

在产品层面,对车内场景进行深度优化可以有效提高产品体验。

例如,用户非常讨厌限制他在与语音系统对话时能说什么以及不能说什么,很多语音交互系统还需要用户记住冗杂的关键命令词。而如小鹏等厂商推出的「所见即所说」,可以有效降低用户学习成本,用户只需要说出在车载屏幕上的内容,就可以进行交互。

产品体验方面,对语音交互的简洁性也有要求。据出门问问叶顺平回忆,三五年前“车载语音可能只有一个唤醒词”、“需要到固定的界面,使用固定的快捷命令词”。而如今语音支持的功能越来越多,如何设计简洁的交互方式来帮用户进行交互,也非常考验VUI产品经理的能力。

只有不断引入先进的技术,并辅之以优秀的产品体验,才能打造出优秀的语音交互系统。

五

目前,在车载语音行业,有三种类型供应商。

第一种,以科大讯飞、Cerence为代表,技术实力强,但产品能力以及配合度相对偏弱。

第二种,以BAT为代表的生态类供应商,技术能力强,如百度的技术能力已经不下于科大讯飞等技术供应商,但问题在于强绑定。

BAT等生态类供应商的优势在于,可以和本生态的导航、音乐等产品做深度整合,打造全闭环的体验。以地图导航为例,BAT相对于技术类厂商,在POI、数据的更新上可以更及时。劣势在于,BAT希望能够掌握车上的入口,一般会有全家桶方案的绑定,控制欲较强,开放程度不够,车企的自主权会比较少。

另外,BAT等厂商并不满足于仅提供系统,他们希望去探索智能座舱生态背后的运营模式,如何能把蛋糕做大,是BAT更关注的。

第三种,镁佳科技等系统集成商,产品能力强,配合度高,但底层语音语义等技术需依赖其他技术供应商。

例如斑马由阿里达摩院提供基础技术,斑马根据产品和需求进行定制,或者根据车厂的需求来定制。

怎么合作?选择与谁合作?未来的节奏怎样的?这些问题都在考验着主机厂对于车载语音的理解以及对未来的判断。

新势力的路线是,借助技术供应商的语音语义方面能力,先做系统集成和上层的应用,然后进一步考虑去建立一部分的语义团队。

在这方面,小鹏最为领先。某业内人士认为,小鹏既承担了一部分技术供应商的角色,又是一个系统集成商,同时它还是主机厂。

对于比较重视产品和体验的新势力企业,可以构建起这样的合作关系和推进计划,而对于习惯了外包的传统车企,又该如何呢?

这里面最重要的问题是重视程度,他们有没有把真正把语音交互看成车内下一代的主要交互方式。

尾声

交互是比算力、通信还要重要的事情。

1979年,乔布斯在施乐PARC研究中心看到了施乐新发明的图形用户界面,程序图标、窗口化、下拉菜单,这些东西深深震撼了年轻的乔布斯,“放佛蒙在我眼睛上的纱布被揭开了一样”“我看到了计算机产业的未来。”乔布斯不吝赞美之词。

现在座舱的问题在于,不论是中控大屏、HUD、视觉、手势、语音,这些方式都不能单独定义下一代的交互。

想象力是比交互还重要的事情。

座舱领域非常需要「Think Big」,这也是我们非常期待苹果、索尼冲击来,把智能座舱搅个底朝天的原因。

按照传统语音供应商的做法,车载语音永远成不了下一代的交互方式。尽管他们已经开始有一些尝试,但是还远远不够。

小鹏等新势力企业已经提供了一种可以跟进的方式,在这条路上,语音开始真正成为用户期待的沟通方式。

在更高级的车载交互中,或许AR/VR+语音交互,将成为车内的主要交互方式。

在这样的座舱内,将不仅可以实现「全真互联网」,语音还将赋予AI以情感、性格。

也只有这样的座舱,才能吃掉我们的时间,成为新一代的茧房。

只有当下一代的交互方式出现的时候,下一代的计算终端也才会崛起,围绕下一代交互的内容、生态才会蓬勃发展。

语音将是智能电动车新时代第一个就位的主要交互方式。

(全文完)