文丨海天

有人的地方就有江湖,OpenAI也一样。

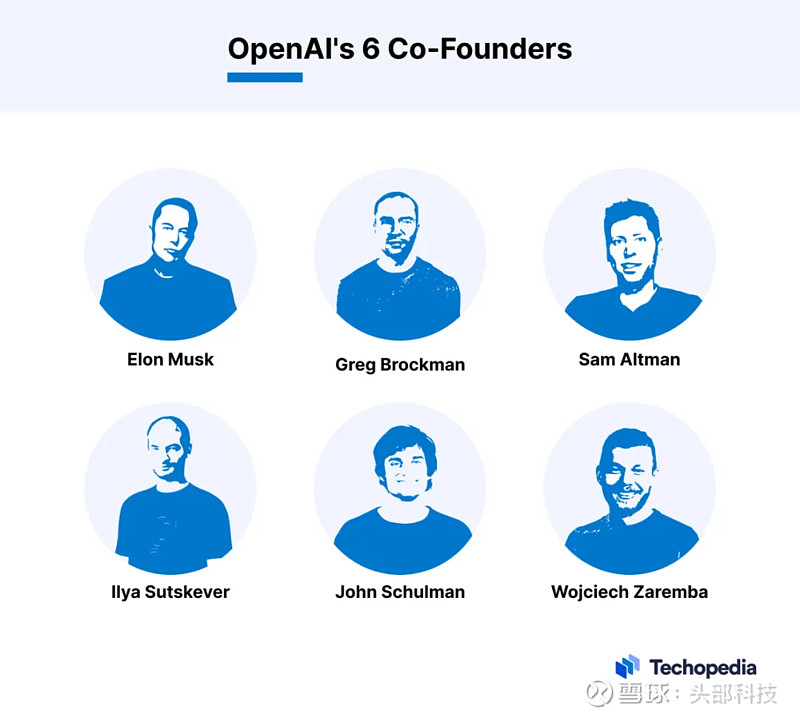

Ilya Sutskever是OpenAI联合创始人、首席科学家,他是OpenAI董事会成员之一。去年年末,OpenAI董事会将另一位创始人Sam Altman驱逐,后来微软介入,Sam Altman又被董事会请回。几天前Ilya Sutskever突然宣布离职。

幕后到底发生了什么?不可能平平静静、和和美美,肯定存在难以言说的斗争。

Sam Altman被驱逐只有5天便带着满身杀气回到OpenAI。

谈到Ilya Sutskever的离开,Sam Altman在接受采访时表示:“对我们所有人来说这是情绪波动的一天,如果没有他,也就没有OpenAI,他塑造了OpenAI,的确如此。”

Ilya Sutskever在声明中表示:“OpenAI的发展充满奇迹,我深信OpenAI将会打造安全、有益的AGI。”

虽然只有寥寥数语,但我们还是看到了Ilya Sutskever的理想,打造AGI是一个宏大的目标,如果真能实现,人类历史将会改写,正因为极其宏大,能否成功、何时成功仍然没有答案!

从谷歌到OpenAI

Ilya Sutskever 1986年生于苏联,5岁前往耶路撒冷,后进入以色列开放大学读书,毕业后进入多伦多大学。2005年Ilya Sutskever拿到数学理学学士学位,2007年拿到计算机理学硕士学位,2013年获得计算机博士学位。

在多伦多读书时,Ilya Sutskever做过许多实验性工作。例如,他曾开发一套软件,软件可以创建类似维基百科一样的无意义条目。2012年Ilya Sutskever与Alex Krizhevsky及博士导师Geoffrey Hinton合作发表论文,探索AI算法。他们研究的项目叫AlexNet,主攻图像识别难题。

Geoffrey Hinton名气很大,是AI领袖人物。看到Ilya Sutskever的研究成果后谷歌抛出橄榄枝,将三人全部招入麾下。Ilya Sutskever向谷歌证明,可以将AlexNet图像识别技术用于文字和句子。后来他又帮谷歌开发TensorFlow,这是一个面向机器学习的端到端开源平台。

在谷歌工作3年后,马斯克邀请Ilya Sutskever一起创建OpenAI。

2015年Sam Altman和马斯克及另一位联合创始人达成一致,想将Ilya Sutskever请到OpenAI。当时Ilya Sutskever还在谷歌工作,对于是否加入离开谷歌他犹豫不决,并没有下定决心。

邀请时OpenAI还没有成立,只是一个专注AI的项目,就在OpenAI正式成立当天,Ilya Sutskever宣布加入,担任首席科学家。

奇怪的他和冲突的他们

Ilya Sutskever离开肯定不是为了钱和权,极可能是理念冲突所致。

之前有报道称,Ilya Sutskever曾焚烧木制雕像,以示自己对AI安全的承诺,他致力于打造能为人类谋福利的AI。

彭博社称,围绕如何降低AI对公众的损害这一问题,Ilya Sutskever曾多次与Sam Altman发生冲突。

OpenAI前总裁Greg Brockman在X发消息称,正是Ilya Sutskever告诉Sam Altman,说他被炒了。

有人认为,可能是AI发展太过迅速导致部分OpenAI员工感到恐惧,大家方向不一致,部分人决定赶走Sam Altman。

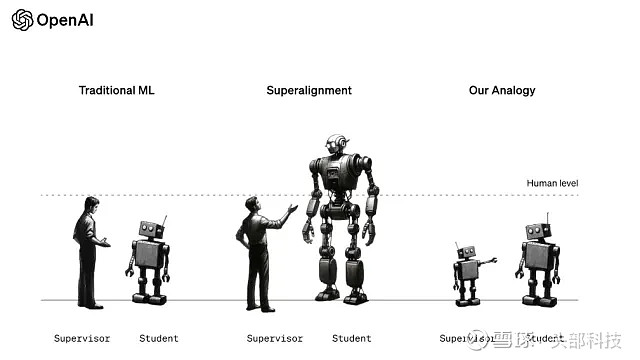

为了保证AI绝对安全,Ilya Sutskever在OpenAI内部创建“Super Alignment”(超级对齐)团队,监督GPT,确保未来的GPT不会伤害人类。

Ilya Sutskever还委托艺术家制作一个木雕,代表“未对齐”AI,烧毁雕像代表着OpenAI致力于创建符合人类利益的AI。

就在Sam Altman回归之后,Ilya Sutskever发消息称:“我无意伤害OpenAI,我后悔参与董事会的行动。”

在OpenAI内部,Ilya Sutskever越来越像一个“精神领袖”,他激励员工努力打造AGI,甚至有些疯狂,他甚至带领员工颂唱:“Feel the AGI!Feel the AGI!”

简言之,Ilya Sutskever似乎已经陷入宗教式疯狂。

动荡造成严重后果!

当初驱逐Sam Altman时,董事会成员Helen Toner、Tasha McCauley和Ilya Sutskever投了赞成票,他们随后都离开了董事会。Adam D’Angelo也投了赞成票,但他仍是董事会成员。

Ilya Sutskever离开后,Jakub Pachocki将会成为OpenAI首席科学家,他于2017年加入OpenAI。

Jan Leike曾和Ilya Sutskever一起领导SuperAlignment团队,Jan Leike也已经离职。

Ilya Sutskever刚宣布离职,几小时后Jan Leike发布一条消息:“我离职了!”他没有过多解释,只有一句短到不能再短的话。

Sam Altman离开了还能回来,Ilya Sutskever则是一去不复返,当中的起起伏伏让人感叹唏嘘。

一切矛盾围绕安全展开

在Ilya Sutskever宣布离职前几天,OpenAI刚刚发布ChatGPT 4o,虽然有进步,但远没有达到颠覆行业的地步。

Ilya Sutskever在离职声明中表示,他深信OpenAI将会开发出安全有益的AGI,他对接下来即将发生的事感到兴奋。

如果Ilya Sutskever神智正常、没有陷入宗教性狂热,他说的话真实可靠没有吹嘘,那么AGI很值得期待,极可能很快就会到来。如果Ilya Sutskever的确已经有些狂热,那他说的话无法作为参考。

即使在离开的最后时刻Ilya Sutskever还在强调说,他担心OpenAI已经偏离了“专注安全”的文化。

对于内部斗争,OpenAI员工保持沉默。即使是离职的前员工,受到苛刻保密协议的约束,他们也不敢发声。可以理解,因为按照协议,员工离职后如果违反保密协议,将会失去股权。

前员工Daniel Kokotajlo称,他之所以离开OpenAI主要是失去信心,他不相信OpenAI在AGI方面能做到负责任。

在硅谷,保密协议并不稀罕,但是违反保密协议将会剥夺股份倒是很少见。

OpenAI新闻发言人回应称:“我们从未剥夺现员工或者前员工的已授予股份,即使员工在离开时没有签署禁止负面评论协议,也没有剥夺过。”

种种迹象显示,在安全问题上,OpenAI内部成员存在分歧。早先OpenAI因为考虑到安全担忧,已经放弃开源,现在又赶走安全监督团队最资深的成员,种种无法自圆其说的行为让外界很困惑,不知道OpenAI到底对安全问题有多重视。

宗教式公司与负责任公司

从DALL-E到ChatGPT,OpenAI不断推出超酷产品,给稍显沉寂的科技产业带来希望。几年之间,OpenAI成为一家宗教式公司,它吸引有着相似信仰的人群。

OpenAI的目标很简单,就是要打造能造福整个人类的AGI。许多员工怀着同样的信仰来到OpenAI,他们认为AGI是完全可以实现的,只需要不到10年(甚至更短)的时间,OpenAI就能开发出超强AI,代替人类完成众多劳作。

到底超级智能能否实现,专家们的看法并不统一,有人乐观,有人悲观。如果能实现,OpenAI必须成为一家负责任的公司,否则危害极大。

OpenAI联合创始人Greg Brockman 2019年曾表示:“我们并不觉得AGI只属于硅谷,它毕竟是一项改变世界的技术。让谁成为正确的代理人,如何正确管理,这是一个大问题。”

为了增强企业责任心,OpenAI设置极为独特的架构,它是一家追求利润的企业,但最终由非盈利团体控制。

Altman去年曾明确表示:“在这里不应该相信任何人,我本人没有超级投票股份,也不需要这样的股票。董事会可以炒掉我,这没什么大不了的。”

从Altman的离去与回归可以看出,董事会的确可以炒掉他,但迫于微软压力,也不是想炒就能随便炒的。

虽然Ilya Sutskever离开了,但OpenAI的目标没有变,实现AGI是最终追求。只是在安全方面OpenAI可能会作出调整,由谁来接替Ilya Sutskever掌管超级对齐团队,OpenAI还没有宣布。

在未来的日子里,OpenAI将会关闭大门,潜心研究,孵化改变人类的AGI。受到保密条款的约束,前员工也无法告诉外界OpenAI到底在做什么。

如果您有什么想说的,欢迎屏幕前你们在评论区留言讨论!

如果您想要获取最新的科技趋势分析、行业内部的独家见解、定期的互动讨论和知识分享、与行业专家的直接面对面交流的机会!

参考链接:

1、网页链接