文丨海天

4月27日,2024中关村论坛年会未来人工智能先锋论坛在北京召开,本论坛以“技术引领,产业革新:探索未来人工智能发展新趋势”为主题,设开幕致辞、成果发布、主旨报告、圆桌对话四大环节,旨在探索未来人工智能发展方向。

论坛集中发布一批人工智能重磅政策和最新创新成果,展示北京人工智能高地建设成效,从中我们可以窥见中国人工智能产业的冰山一角。

未来北京不只要在海淀区建设人工智能创新街区,还要在2026年初步建成全国具身智能原始创新策源地。

今年的人工智能先锋论坛到底给我们带来哪些惊喜?又给中国人工智能产业提供了哪些洞见?我们简单盘点一下。

对标Sora的国产视频大模型Vidu

在成果发布环节,生数科技联合清华大学正式发布中国首个长时长、高一致性、高动态性视频大模型——Vidu。

清华大学人工智能研究院副院长、生数科技联合创始人兼首席科学家朱军教授介绍称,Vidu采用Diffusion与Transformer融合的架构U-ViT,可以一键生成1080P高清视频内容。据介绍,U-ViT架构是2022年9月提出的,早于Sora DiT架构,更是全球首个将Diffusion与Transformer融合的架构。

Vidu在多个维度实现突破,它可以模拟真实物理世界,具有想象力,能理解多镜头语言,能理解中国元素。所谓具有想象力,就是指Vidu能生成虚构场景,生成超现实主义画面。

朱军教授称:“我们一镜到底,目前最长能制作16秒视频,而且是单一大模型,不需要任何的插帧和剪切,实现端到端的生成。”

有些生成工具会通过插帧拉伸视频长度,Vidu没有投机取巧,难能可贵。

,时长01:26

Vidu的迭代速度相当快,今年1月只能生成4秒视频,到了3月底突破8秒,4月份再度升级,可以制作16秒视频,未来还会继续将视频时间延长。

生数科技是一家新生企业,2023年3月才成立,它致力打造世界领先的多模态大模型,该模型可以生成图像、3D内容和视频。

低碳高性能开源多语言大模型Tele-FLM

在论坛上,北京智源人工智能研究院与中国电信人工智能研究院(TeleAI)联合发布开源多语言大模型Tele-FLM,低碳、高性能和全面开源是它的最大特色。

北京智源人工智能研究院理事长黄铁军教授称,Tele-FLM支持80%以上的主流全球语言,在中文和英文方面表现卓越,超越了Llama1、Llama2和Llama3,Tele-FLM Chat有着优秀的对话能力,经过测试,它已经超过了ChatGPT3.5,目前已经在自动驾驶和工业应用中初见成效。

相比Llama3,Tele-FLM对算力的要求更低。Llama3拥有多个版本,最小的Llama3模型拥有70B参数,训练时调用约5万块H100,Tele-FLM训练50B模型,训练同样规模的数据,所用的算力不到Llama3的1/10。

最新发布的模型有520亿参数,训练了两个月,完成了2T Token的训练;未来3个月,研发方还将发布拥有千亿、六千亿和万亿参数的模型,争取今年6月份发布万亿模型。

黄铁军承诺,Tele-FLM全面开源,包括核心技术、模型权重、训练细节,所有一切都是开放的。

用光电智能计算解决能耗问题

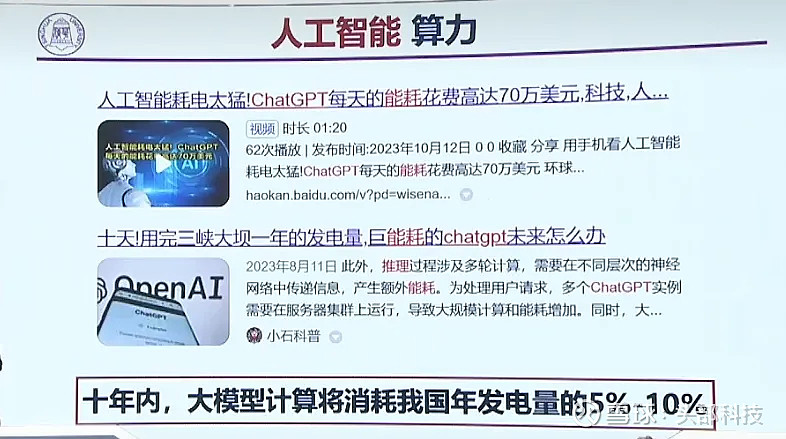

主旨演讲环节,中国工程院院士、中国人工智能学会理事长戴琼海向听众介绍了“光电智能计算”概念,大模型训练需要巨大的算力,强大算力又离不开庞大的电力,“光电智能计算”技术有望解决此问题。

戴琼海称:“未来五年左右,我们十天算力的用电量将会变得相当于三峡大坝水电站一年的发电量,很恐怖很可怕。”

清华大学研究团队创造性提出光电融合的全新计算框架,并研制出国际首个全模拟光电智能计算芯片ACCEL,这一成果正是出自戴琼海院士之手。

戴琼海教授称:“很大的视频如果用A100来处理,要十台、一百台以上才行,现在直接一台光计算机就可以解决。”

相比A100芯片,ACCEL芯片可以大幅降低能耗,这是它的最大优势,目前该芯片正在开展各方面的测试和应用。

人类离AGI和具身智能有多远

北京海淀区将具身智能视为重点发展的前沿领域,并发布了《打造全国具身智能创新高地三年行动方案》,聚焦具身大模型和机器人整机,力求尽快研制一批国内领先、国际先进的多形态机器人。

为了呼应这一战略,今年的圆桌对话围绕“具身智能”展开,星动纪元、傅利叶智能、智元机器人、银河通用等企业的负责人参与讨论,他们的一些观点让人耳目一新、振聋发聩。

在过去几年里,人工智能飞速进化,人类似乎看到了AGI实现的可能性。ACM 杰出科学家李航博士认为,未来五到二十年AGI很有可能会实现。星动纪元创始人陈建宇也很乐观,他认为AGI会实现,而且很有可能通过具身智能来实现,未来AGI具身智能不光具备语言能力,还有图像处理能力和控制身体的能力。

银河通用机器人创始人、智源具身智能研究中心负责人王鹤则说:“具身智能与非具身智能非常互补,他们的全集才是AGI。”因为具身智能可以赋予AI与物理世界交互的能力,如果AI单纯阅读数据是无法获得此能力的。

智元机器人联合创始人、上海人工智能研究院院长宋海涛没有那么乐观,他认为通往AGI的路将会非常漫长,因为人类有文明史记载五千年,需要全社会进行大模型语料库建设,进行千亿、万亿级训练,把各行各业大模型建立以后才能逐步迈向具身智能,这个过程是漫长的。

宋海涛称:“人工智能从最早的视觉到图像、文本、语音,现在到多模态,到具身,这10年间发展出了很多路径,但离大规模的商用都还存在很大的距离。在具身智能这个方向,我们认为垂类模型加协同机器人,对于行业来说,未来3-5年是一个逐步的渗透期。”

展望未来,李航博士表示:“有人说20世纪是计算机的时代,21世纪是什么时代我们不知道,现在还没到一半,很有可能就是人工智能时代。整个世纪,具身智能至少占其中一半,AGI离不开身体。所以整个21世纪,具身智能应该是在这个时代里面最具代表性的技术领域。”