这几天,大家都在吹英伟达,什么“核弹”、“炸场”、“史诗级”词汇都用上了。

其实中国并不比英伟达差。

我们仔细剖析一下英伟达Blackwell架构的B200芯片,可以看到其与互联技术有密切关系。

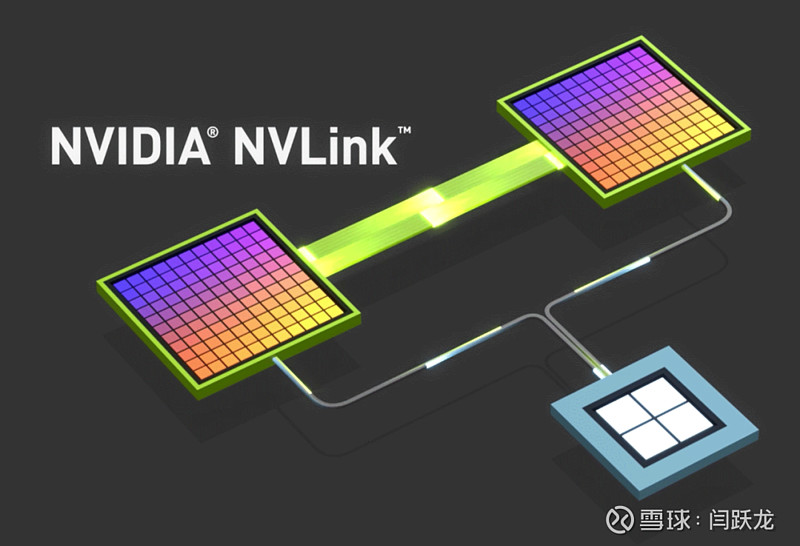

一个是单个服务器内多个GPU互联的NVLINK技术,B100芯片使用的第五代NVLINK技术为每个 GPU 提供了突破性的1.8TB/s 双向吞吐量,确保多达576个GPU 之间的无缝高速通信。

另一个是不同服务器的GPU之间的NV Switch技术,每个NVSwitch都可以最多支持16个GPU互联,并且在使用NVSwitch进行互联的时候,不仅能够达到高速的效果,同时还能够保证每一个GPU和连接GPU之间都能够保持超低延迟的通讯。

说直白点,B200芯片并不是单一的GPU,而是通过互联,将多个GPU集成在一起。

为什么会这样?因为摩尔定律失效,单个芯片的提升面临瓶颈,要想提升算力,就需要通过互联、堆叠的方式实现。

比如,台积电的3nm制程,其实并没有给芯片性能带来革命性的变化。去年的苹果A17 Pro芯片,用了台积电的3nm制程,但是CPU性能只有10%的提升。

黄仁勋说," 创新不仅仅是芯片,而是整个堆叠 ",就是这个道理。

具体到AI大潮,对算力的需求是几何级增长,这个时候再指望单个芯片的性能提升已经不行,唯有通过多个GPU之间的高速互联。

换句话说,就是将GPU高速互联形成集群,这就相当于把AI的算力中心当做一台超级计算机来进行设计。

这种情形对于中国恰恰是机会。

因为众所周知的原因,我们不能使用先进制程制造芯片,但是这可以通过高速互联的集群来弥补。以华为为例,华为最擅长的就是联接,就是通信。与英伟达NVLINK对应的,是华为的HCCS,比如昇腾910B的HCCS总带宽为392GB/s,和英伟达A800 NVLINK的400GB/s相当。其他还有 PCIe 4.0、100G等高速互联技术。

华为正确预判到了集群的大方向,华为昇腾计算业务总裁张迪煊透露,早在2018年,华为就判断人工智能会快速发展,并改变过去小模型的开发模式,形成大算力结合大数据生成大模型的模式,因此华为早在6年前就开始在算力集群上发力。

压强式投入,让华为在算力集群上已经实现了重大突破。在2023年7月举行的昇腾人工智能产业高峰论坛上,华为宣布昇腾AI集群全面升级,集群规模从最初的4000卡集群扩展至16000卡,是业界首个万卡AI集群,拥有更快的训练速度和30天以上的稳定训练周期,十倍领先业界。

去年9月,华为推出全新架构的昇腾AI计算集群——Atlas 900 SuperCluster,可支持超万亿参数的大模型训练。新集群采用了全新的华为星河AI智算交换机CloudEngine XH16800,借助其高密的800GE端口能力,两层交换网络即可实现2250节点(等效于18000张卡)超大规模无收敛集群组网。

按照昇腾的指标,1000卡的算力约300P,千卡就能提升约30P,万卡就能提升约300P。

想象一下,18000张GPU卡高速互联在一起,是什么景象?这才是史诗级的超级AI计算机!

据了解,目前国产大模型有超过一半都是基于昇腾AI孵化出来的。

所以,无需过分吹捧英伟达,无需对自身妄自菲薄,中国在万卡集群上已经走到了世界前列,在算力基础设施上并不差。